显卡驱动这种底层软件,向来是C/C++的天下,代码量动辄百万行,调试起来能把人逼疯。但就在几天前,AMD一位资深副总裁兼工程师Anush Elangovan,居然用AI(Anthropic Claude Code)写了一个Radeon驱动——而且是用Python。消息一出,很多人第一反应是:AMD要用AI取代传统驱动了?别急,事情远没那么简单,甚至可以说,这个“驱动”压根就不是你理解的那个驱动。

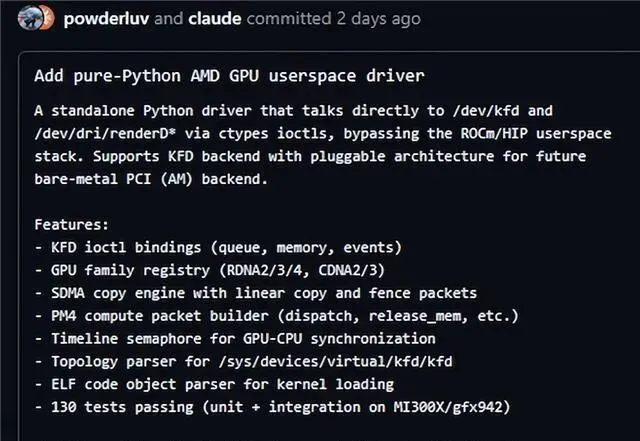

先看它干了什么。这套Python代码能直接访问 /dev/kfd 和 /dev/dri/render* 这类设备节点,绕过了AMD引以为傲的ROCm软件栈——就是那个负责把应用程序指令层层翻译给GPU内核驱动的中间层。通过这种直连方式,它可以分配GPU内存、创建计算队列、提交指令包,还能同步CPU和GPU的工作。听起来很底层,对吧?但真相是,真正的内核驱动(AMDGPU)纹丝未动,所有繁重的活还是它在干。Python层只是封装了指令包,通过现有内核API发出去而已。

这就像用笔记本电脑临时接管汽车的发动机控制器——能诊断故障、读数据,但没人会拿它当正常驾驶系统用。Elangovan自己也说,这是个实验性质的测试框架,目的是在高度可控的环境下与GPU硬件交互,而不必依赖整套ROCm。对于内部开发来说,这简直是神器:工程师可以快速隔离ROCm里的bug,或者测试某个GPU功能,再也不用编译庞大的C++项目了。

当然,它已经能干些实际活了:创建队列、内存分配、调度计算包、实现CPU-GPU同步信号……代码量小、Python写起来快、改起来方便,特别适合需要反复复现硬件行为的测试场景。但也仅此而已。想靠它跑Vulkan游戏?想多了。生产级驱动需要的着色器编译器、电源管理、安全层、多任务调度,这里一样都没有。

有人可能会问:那它未来有没有可能演变成真正的驱动?概率极低。且不说Python的性能瓶颈,单是绕过内核驱动就意味着失去虚拟内存、DRM等核心功能,只能用于裸机PCI诊断或极低级别的硬件启动。Elangovan的发布说明里也提到了“未来裸机PCI后端”的设想,那才是它的真正归宿——不是替代,而是给底层调试多一把螺丝刀。

所以,如果你期待一个Python写的日常驱动,大概率要失望了。但这个项目确实撕开了一个口子:AMD的Linux内核接口已经开放到这种程度,以至于用高级语言写脚本就能直接操作。更重要的是,它证明了AI在驱动开发中的辅助价值——从无到有搭一个测试框架,全程不用开编辑器,速度本身就是护城河。

对普通用户来说,这件事最大的意义或许是:未来的驱动开发可能会更灵活,调试工具会更丰富。但短期内,该装ROCm还得装,该等官方更新还得等。如果你是个爱折腾的开发者,倒是可以盯着这个项目,没准哪天能帮你省下半天编译时间。

最后留个思考题:你觉得用AI写驱动,是未来的趋势,还是只是极客的玩具?评论区聊聊。顺手收藏本文,下次跟朋友聊显卡驱动时,你也能讲出点不一样的门道。