怎么利用Linux脚本和工具提高工作效率

简介:本文聚焦Linux运维核心,揭示“自动化、批量处理、组合复用”三大提效秘诀。文章摒弃晦涩理论,通过日志自动归档、集群批量配置更新、攻击IP秒级封禁等实战案例,演示如何用简单Shell脚本替代繁琐人工操作。无论是定时任务解放人力,还是管道工具组合解决突发难题,旨在帮助读者将重复劳动转化为代码逻辑。掌握这些易学实用的技巧,不仅能大幅缩短工作耗时,更能降低人为错误,助您从手动“操作工”进阶为高效自动化专家。

详细内容请参考下文。

一、Linux环境设置

说明:这里主要设置SSH免密登录其他服务器,要实现从服务器A(xtserver)免密登录服务器B(DNSserver),只需三步即可完成。

1.在服务器A生成密钥对

说明:在本地电脑或管理机上执行以下命令。此步骤用于创建用于身份验证的密钥对,一路回车使用默认值即可。

执行指令# ssh-keygen -t rsa

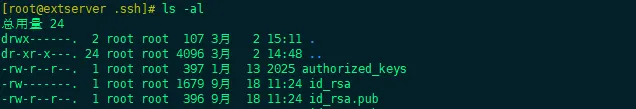

执行后,在 ~/.ssh/目录下会生成两个文件:

id_rsa:私钥(请妥善保管,切勿泄露)

id_rsa.pub:公钥(需要复制到目标服务器)

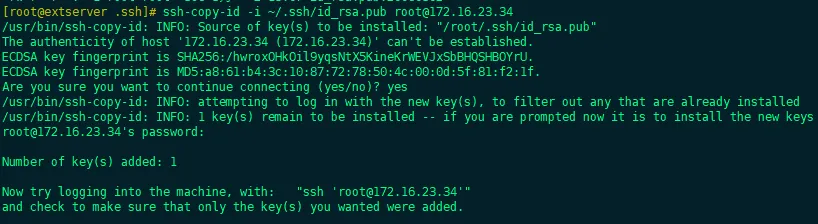

2.将公钥复制到服务器B

说明:这里推荐使用ssh-copy-id命令一键完成复制。将 user和 192.168.1.100替换为您的目标服务器信息。

执行指令# ssh-copy-id -i ~/.ssh/id_rsa.pub user@192.168.1.100

执行后,根据提示输入一次服务器B的密码,自动完成公钥的追加。

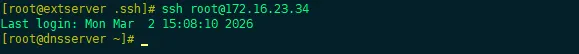

3.测试免密登录

完成以上步骤后,即可从服务器 A 免密登录服务器 B。首次连接时,按提示输入 yes确认即可。

执行指令# ssh root@172.16.23.34

如果无需输入密码即可成功登录,则表示配置成功。

二、实际案例

说明:Linux提升效率的核心秘诀其实只有三个词:自动化、批量处理和组合复用。通过编写简单的Shell脚本和巧妙运用原生工具,我们可以将繁琐的“体力活”交给机器,让人类专注于更有价值的架构设计与问题解决。

1.自动化:让机器替你“值班”

说明:自动化的本质是“一次编写,永久运行”。它将人工需要反复确认、执行的步骤固化为代码,确保任务在特定时间或特定条件下精准执行,彻底解放人力。

实例:智能日志清理与归档

工作痛点:生产服务器每天产生数百兆的应用日志。如果不及时清理,磁盘很快爆满;如果手动删除,又担心误删近期文件,且无法保留历史数据以备审计。

解决方案:编写一个脚本,自动检测日志大小,将超过30天的旧日志压缩归档,并删除更早的备份,同时发送执行报告。

效率提升点:原本每周需要花费半小时人工检查、压缩、移动的操作,现在完全无人值守。不仅避免了磁盘溢出风险,还建立了标准化的数据留存机制。

实操步骤:

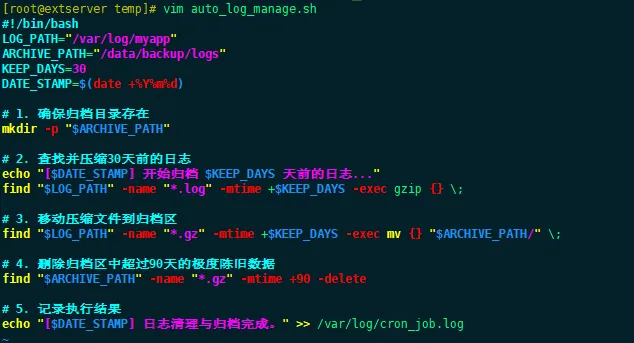

(1)创建脚本 auto_log_manage.sh

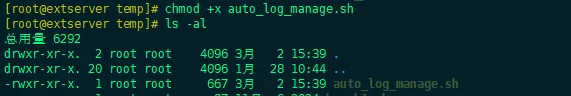

(2)授权脚本程序

执行指令# chmod +x auto_log_manage.sh

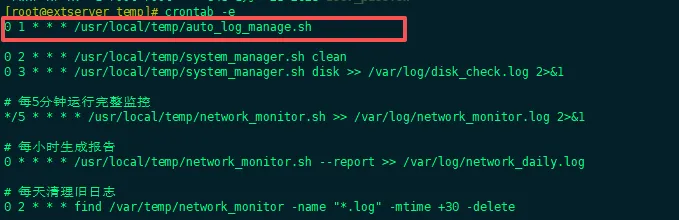

(3)部署定时任务

使用 crontab -e 设置每天凌晨1点自动执行:

0 1 * * * /root/scripts/auto_log_manage.sh

2.批量处理:告别“单兵作战”,实现“集团化推进”

说明:在管理多台服务器或处理大量文件时,逐个操作是效率的大敌。批量处理的核心在于利用循环结构(Loop)和并行工具,将针对单一对象的操作瞬间复制到成千上万个对象上。

实例:批量更新集群服务器配置

工作痛点:公司内有100台应用服务器,按要求需紧急修改SSH配置文件中的 MaxAuthTries 参数。如果一台台登录修改,耗时至少两小时,且容易漏改。

解决方案:利用Shell循环结合 ssh 和 sed 工具,一键完成所有服务器的配置更新。

效率提升点:将几个小时的人工操作缩短为2分钟。更重要的是,脚本保证了所有服务器配置的一致性,消除了人为输错命令的风险。对于文件处理,类似的逻辑也可用于批量重命名、格式转换等场景。

实操步骤:

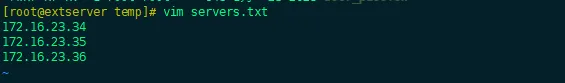

(1)准备服务器列表 servers.txt

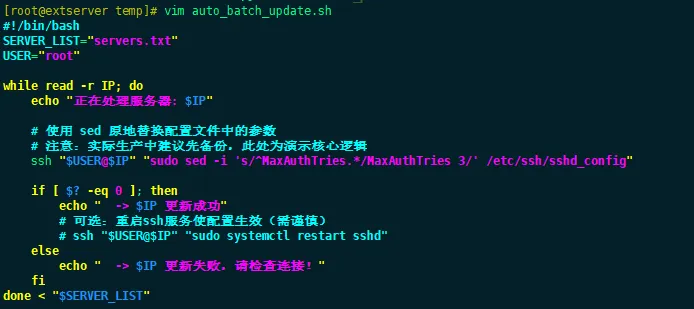

(2)编写批量更新脚本auto_batch_update.sh

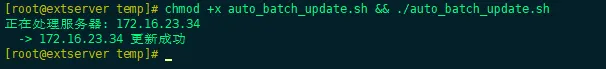

(3)授权并执行脚本

chmod +x auto_batch_update.sh && ./auto_batch_update.sh

3.组合复用:像搭积木一样构建强大功能

说明:Linux的精髓在于“每个工具只做一件事,但要做到极致”,然后通过管道符(|)将它们组合起来。这种“组合复用”的能力,让我们无需编写复杂程序,就能在命令行中快速构建出强大的数据处理流。

实例:一键揪出“暴力破解”SSH的恶意IP

工作痛点:Linux服务器的 /var/log/secure(CentOS/RHEL)或 /var/log/auth.log(Ubuntu/Debian)记录了所有的登录尝试。当服务器暴露在公网时,往往会遭受自动化的脚本攻击,每秒产生数十条“Failed password”记录。

人工查看时,面对刷屏般的日志,很难快速分辨出哪些IP是偶然输错密码,哪些IP正在进行高频暴力破解。如果反应慢了,服务器可能已被攻破。

解决方案:利用“组合复用”思想,将日志过滤、字段提取、计数排序串联起来,瞬间从成千上万条杂乱日志中,揪出攻击频率最高的前5个IP地址。

效率提升点:第一化繁为简,将原本需要打开巨型日志文件、滚动搜索、人工计数的半小时工作,压缩成一行命令的1秒钟。第二动态适应,无论日志里有10条还是10万条失败记录,这套“积木”组合都能自动适应,精准输出Top榜单。第三决策辅助,通过量化数据(攻击次数),让管理员能果断决策封禁对象,避免误伤偶尔输错密码的内部员工。

实操步骤:

(1)分析日志特征

在 /var/log/secure 中,失败的SSH登录通常包含关键词 Failed password,且IP地址通常位于倒数第4列(格式如:Failed password for invalid user admin from 192.168.1.50 port 22 ssh2)。

(2)搭建“积木”链条

积木一(过滤):使用 grep 只保留包含 "Failed password" 的行,剔除成功登录和其他无关信息。

积木二(提取):使用 awk 提取每行的倒数第4列(即IP地址)。

积木三(排序):使用 sort 将IP地址排序,使相同的IP相邻,为去重统计做准备。

积木四(统计):使用 uniq -c 统计每个IP出现的次数,并在行首显示数量。

积木五(排行):使用 sort -nr 按数字大小倒序排列,让攻击最猛的IP排在最前面。

积木六(截取):使用 head -n 5 只取前5名,直击要害。

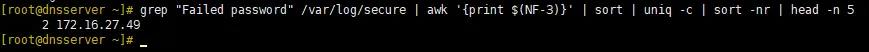

(3)执行以下指令

grep "Failed password" /var/log/secure | awk '{print $(NF-3)}' | sort | uniq -c | sort -nr | head -n 5

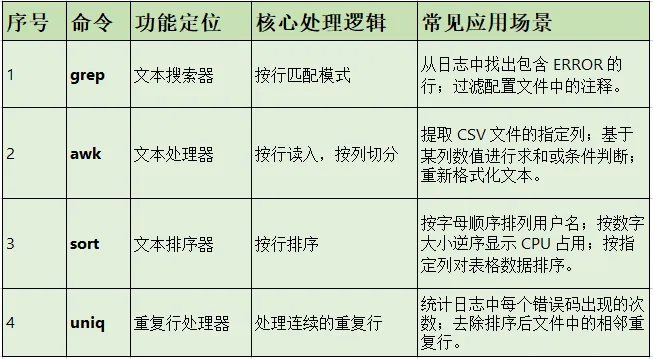

Linux命令的详细功能如下