OpenClaw | Linux 部署 · 接入飞书 · 拉进群聊

养一只自己的龙虾 🦞,让它住进你的飞书。

最近 OpenClaw(江湖人称「龙虾」🦞)火了。

它能干嘛?简单说:你在飞书里发一条消息,它就能帮你搜资料、写代码、读文档、操作浏览器、管理文件——像一个 24 小时在线的全能助手,而且跑在你自己的服务器上,数据完全属于你。

不是那种只能聊天的套壳 GPT。这只龙虾能真正动手干活。

听起来不错?这篇文章教你三步拥有自己的龙虾:在 Linux 上部署、接入飞书、拉进群聊让朋友一起用。全程命令可复制,配置可粘贴,不需要域名,不需要公网 IP,一台最基础的云服务器就够。

📋 目录

第一部分:Linux 部署

第二部分:接入飞书

第三部分:拉进群聊

第一部分:Linux 部署

1.1 准备一台 Linux 服务器

你需要一台 Linux 服务器。可以是:

- 云服务器(腾讯云、阿里云、AWS、Oracle Cloud 等)

推荐配置:

- 系统:Ubuntu 20.04 / 22.04 LTS

确保你能通过 SSH 连接到服务器:

ssh your-user@your-server-ip

1.2 安装 Node.js

OpenClaw 需要 Node.js 22 或更高版本。

# 添加 NodeSource 仓库并安装

curl -fsSL https://deb.nodesource.com/setup_22.x | sudo -E bash -

sudo apt-get install -y nodejs

# 验证版本

node -v # 应该显示 v22.x.x 或更高

npm -v # 应该显示 10.x.x 或更高

💡 如果你的系统自带的 Node 版本太低,上面的命令会自动替换为新版本。

1.3 安装 OpenClaw

OpenClaw 提供了一键安装脚本:

curl -fsSL https://openclaw.ai/install.sh | bash

这个脚本会自动检测 Node.js、安装 OpenClaw CLI、并启动配置向导。

如果你更喜欢手动安装:

# 设置 npm 全局目录(避免权限问题)

mkdir -p "$HOME/.npm-global"

npm config set prefix "$HOME/.npm-global"

echo 'export PATH="$HOME/.npm-global/bin:$PATH"' >> ~/.bashrc

source ~/.bashrc

# 安装 OpenClaw

npm install -g openclaw@latest

# 运行配置向导

openclaw onboard --install-daemon

安装完成后验证:

openclaw --version # 查看版本

openclaw doctor # 检查配置

1.4 配置 AI 模型(API Key)

OpenClaw 本身不包含 AI 模型,你需要接入一个模型提供商。支持的主流选项:

- Anthropic(Claude Sonnet / Opus)

配置方式:运行 openclaw onboard 时向导会引导你填写,或者直接编辑配置文件 ~/.openclaw/openclaw.json:

{

"models": {

"providers": {

"openai": {

"baseUrl": "https://api.openai.com/v1",

"apiKey": "sk-你的API密钥",

"api": "openai-responses",

"models": [

{

"id": "gpt-4o",

"name": "GPT-4o",

"contextWindow": 128000,

"maxTokens": 4096

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-4o"

}

}

}

}

💡 如果你用的是第三方 API 代理(比如各种中转站),只需要把 baseUrl 改成对应的地址就行。

1.5 启动并验证

# 启动 Gateway(后台服务)

openclaw gateway start

# 查看状态

openclaw gateway status

# 查看实时日志

openclaw logs --follow

看到类似这样的输出就说明启动成功了:

Gateway: running (pid 12345)

Listening: 127.0.0.1:1878

💡 OpenClaw 会自动注册为 systemd 服务,开机自启,不用担心重启后丢失。

第二部分:接入飞书

这一部分教你在飞书开放平台创建一个机器人应用,然后把它和 OpenClaw 连起来。

2.1 创建飞书应用

2.2 获取应用凭证

创建完成后,进入应用详情页:

⚠️ App Secret 是敏感信息,不要泄露给任何人。

2.3 配置权限

在左侧菜单找到「权限管理」,点击「批量开通」,粘贴以下 JSON:

{

"scopes": {

"tenant": [

"im:message",

"im:message:send_as_bot",

"im:message.p2p_msg:readonly",

"im:message.group_at_msg:readonly",

"im:message:readonly",

"im:resource",

"im:chat.access_event.bot_p2p_chat:read",

"im:chat.members:bot_access",

"contact:user.employee_id:readonly",

"application:bot.menu:write"

],

"user": [

"im:chat.access_event.bot_p2p_chat:read"

]

}

}

这些权限的作用:

im:resource:让机器人能处理图片、文件等资源

2.4 开启机器人能力

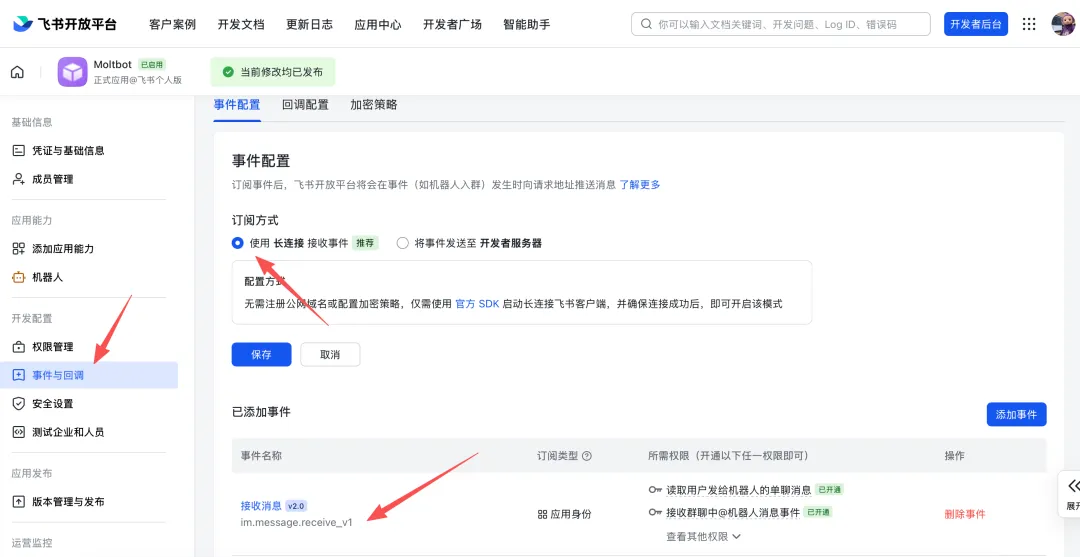

2.5 配置事件订阅

⚠️ 重要:先完成下一步(2.6)再回来配置事件订阅! 因为飞书需要验证 WebSocket 连接,而这需要 OpenClaw 的 Gateway 正在运行。

配置步骤:

- 选择「使用长连接接收事件」(WebSocket 模式)

- 添加事件:

接收消息 im.message.receive_v1

💡 为什么选 WebSocket?因为它不需要你的服务器有公网域名或配置 HTTPS,飞书会主动连过来。这对个人部署非常友好。

2.6 在 OpenClaw 中接入飞书

回到你的服务器终端,安装飞书插件并配置:

# 安装飞书插件

openclaw plugins install @openclaw/feishu

# 添加飞书频道

openclaw channels add

选择 Feishu,然后粘贴你的 App ID 和 App Secret。

或者直接编辑配置文件 ~/.openclaw/openclaw.json,在 channels 部分添加:

{

"channels": {

"feishu": {

"enabled": true,

"appId": "cli_你的AppID",

"appSecret": "你的AppSecret",

"connectionMode": "websocket",

"domain": "feishu",

"dmPolicy": "open",

"allowFrom": ["*"]

}

},

"plugins": {

"allow": ["feishu"],

"entries": {

"feishu": {

"enabled": true

}

}

}

}

配置说明:

connectionMode: "websocket":使用长连接,不需要公网 IPdomain: "feishu":国内飞书用 feishu,国际版 Lark 用 larkdmPolicy: "open" + allowFrom: ["*"]:允许所有人私聊(后面会讲怎么限制)

然后重启 Gateway:

openclaw gateway restart

2.7 发布应用

回到飞书开放平台:

💡 企业自建应用通常会自动审核通过(如果你是管理员的话)。

2.8 发送第一条消息

如果一切配置正确,你会看到机器人回复你!🎉

如果使用了 pairing 模式(默认),第一次对话时机器人会返回一个配对码,你需要在服务器上批准:

# 查看待配对列表

openclaw pairing list feishu

# 批准配对

openclaw pairing approve feishu <配对码>

批准后就可以正常聊天了。

第三部分:拉进群聊

到这里,你已经有了一个能在飞书私聊中使用的 AI 助手。但更有意思的是——把它拉进群聊,让一群人一起用。

3.1 把机器人拉进群聊

操作非常简单:

添加成功后,群里所有人都能看到机器人,并且可以和它互动。

💡 只有群主或群管理员才能添加机器人。如果你不是群主,让群主帮你加一下。

3.2 群聊中的使用方式

群聊里的机器人和私聊有一个关键区别:默认需要 @机器人 才会响应。

这是合理的设计——你不会希望群里每条消息机器人都插嘴。

使用方式:

@我的AI助手 帮我总结一下今天的讨论要点

@我的AI助手 这段代码有什么问题?

机器人只会回复 @ 了它的消息,其他聊天不会被打扰。

💡 群聊中的对话是独立会话,和你跟机器人的私聊互不干扰。不同群聊之间也是隔离的。

3.3 群聊权限配置

在 OpenClaw 侧,你可以精细控制群聊行为。编辑 ~/.openclaw/openclaw.json:

允许所有群聊(默认)

{

"channels": {

"feishu": {

"groupPolicy": "open"

}

}

}

只允许特定群聊

{

"channels": {

"feishu": {

"groupPolicy": "allowlist",

"groupAllowFrom": ["oc_群聊ID_1", "oc_群聊ID_2"]

}

}

}

完全关闭群聊功能

{

"channels": {

"feishu": {

"groupPolicy": "disabled"

}

}

}

💡 群聊 ID(chat_id)格式是 oc_xxx,可以在飞书群设置中查看,或者在 OpenClaw 日志中找到。

3.4 高级玩法:多群不同配置

如果你有多个群,想给不同群设置不同的规则:

{

"channels": {

"feishu": {

"groupPolicy": "open",

"groups": {

"oc_工作群ID": {

"requireMention": true

},

"oc_闲聊群ID": {

"requireMention": false

}

}

}

}

}

requireMention: true(默认):必须 @ 机器人才响应requireMention: false:群里每条消息都会响应(适合专门的 AI 讨论群)

你还可以限制特定群里只有某些人能触发机器人:

{

"channels": {

"feishu": {

"groups": {

"oc_某群ID": {

"allowFrom": ["ou_用户A的open_id", "ou_用户B的open_id"]

}

}

}

}

}

🎯 总结

恭喜你!现在你拥有了:

- ✅ 一台运行 OpenClaw 的 Linux 服务器

整个过程不需要域名、不需要 HTTPS 证书、不需要公网 IP(感谢 WebSocket 长连接),一台最基础的云服务器就够了。

如果你在部署过程中遇到问题:

- OpenClaw 官方文档:https://docs.openclaw.ai

- GitHub 仓库:https://github.com/openclaw/openclaw

- 社区 Discord:https://discord.com/invite/clawd

这不只是一个聊天机器人。它是你的 AI 助手,住在你的服务器上,听你的话,帮你干活。拉进群聊,朋友们也能一起享受这个牛🦐。