自然语言太模糊,TypeScript 噪音太多——Python 刚好在中间,用最少的符号,表达最完整的商业思想。对创业者和一人公司来说,这个特性在 AI Agent 时代价值巨大。

引言

在一人公司的实践中,我一度以为"用自然语言指挥 AI 干活"就够了——直到发现每次用自然语言描述需求,AI 都需要猜测太多细节,结果偏差很大,改来改去浪费大量时间。

切换到 Python 之后,同样的逻辑,十几行代码说清楚,AI 的输出质量上了一个台阶,协作效率明显不一样。

这让我意识到:Python 在 AI 时代的角色正在发生质变。 它不再只是数据科学家的工具,而是一人公司与 AI 之间最经济、最精确的沟通语言——用最少的符号,把商业判断完整传递给 AI。

本文是我这段时间实践的一些心得体会。

一、沟通成本:创业者最容易忽视的隐性损耗

创业者每天面对的核心挑战,不只是"做什么",更是"怎么让别人理解我要做什么"。

在 AI 出现之前,这个"别人"是工程师团队。创业者需要把商业想法翻译成产品需求文档,工程师再把需求文档翻译成代码。每一次翻译都有信息损耗,每一次损耗都可能导致最终产品偏离初衷。

在 AI 时代,这个"别人"变成了 LLM。但沟通成本的问题并没有消失,只是换了一种形式。

考虑三种表达同一个业务逻辑的方式:

方式一:自然语言

"帮我做一个报告生成功能,根据用户输入的需求,调用 AI 生成带图表的分析报告"

这句话有多少歧义?图表是什么类型?数据从哪里来?报告的格式是什么?输出到哪里?LLM 需要猜测大量细节,结果往往偏差很大。

方式二:TypeScript

interfaceReportConfig {

userInput:string;

chartTypes: ('bar'|'line'|'pie')[];

outputFormat:'html'|'pdf';

dataSource:DataSourceConfig;

}

asyncfunctiongenerateReport(config:ReportConfig): Promise<ReportOutput> {

// 还没写业务逻辑,光类型定义就十几行

}

精确,但噪音太多。类型声明、接口定义占据了大量篇幅,核心业务逻辑被稀释,LLM 需要处理大量工程细节才能理解你真正想做什么。

方式三:Python

def generate_report(user_input: str) -> str:

prompt = build_prompt(user_input)

response = call_llm(prompt)

charts = parse_charts(response)

return render_html(charts)

四行代码,完整表达了业务逻辑的全貌。没有多余的噪音,LLM 一眼就能理解你的意图,然后帮你填充每一个函数的实现细节。

这就是 Python 的核心优势:在精确度和经济性之间,它是唯一两者兼得的选择。

| 表达方式 | 精确度 | 经济性 | 适合场景 |

|---|---|---|---|

| 自然语言 | ⭐⭐ | ⭐⭐⭐⭐⭐ | 模糊需求描述 |

| Python | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | 核心逻辑表达 |

| TypeScript | ⭐⭐⭐⭐⭐ | ⭐⭐ | 产品工程化交付 |

这种精确性是双向的。

你用 Python 让 AI 理解你的意图,AI 同样可以用 Python 伪代码来表达它的方案——而你也能精确读懂。

当 AI 用自然语言描述方案时:

"我会先读取文件,然后解析内容,再调用 LLM 分析,最后输出结果报告"

你可能觉得听懂了,但这句话里充满了歧义:文件是什么格式?解析到什么程度?LLM 怎么调用?结果存到哪里?你无法判断 AI 的方案是否真的正确。

但如果 AI 用 Python 伪代码来表达同一个方案:

def process_pipeline(file_path: str) -> str:

raw_text = read_pdf(file_path) # 读取 PDF,提取纯文本

chunks = split_by_section(raw_text) # 按章节切分

analyses = [call_llm(chunk) for chunk in chunks] # 逐段调用 LLM 分析

return merge_and_render(analyses) # 合并输出为报告

你立刻就能看清楚:AI 打算干什么、每一步的顺序是什么、数据是怎么流动的。如果哪一步不对,你可以精确地指出来,而不是在自然语言的模糊描述里猜测分歧究竟在哪里。

Python 让沟通精确度双向提升:你用 Python 让 AI 听懂你,AI 用 Python 让你看懂它。 这才是真正地消除信息损耗,而不只是单方向的"翻译"。

二、Python 是 AI 的母语,不是比喻

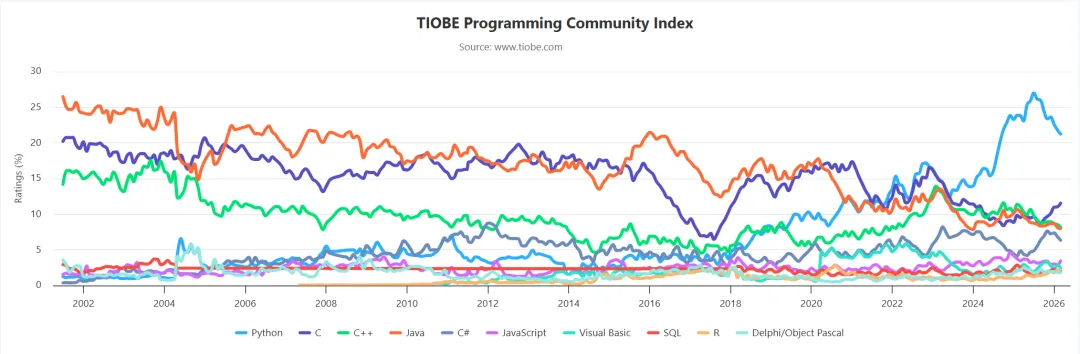

说 Python 是 AI 的"母语",有实质依据。

从训练数据看,GitHub 上 Python 代码库的数量和质量在所有语言中名列前茅,LLM 在训练过程中接触了海量的 Python 代码,形成了对 Python 语法、惯用法、生态系统的深度理解。

从生态系统看,几乎所有 AI 基础设施都以 Python 为第一公民。OpenAI、Anthropic 的官方 SDK,Python 版本的文档永远更详细、更新更及时。LangChain、AutoGen、CrewAI、LlamaIndex——所有主流 Agent 框架都是 Python 优先。

从实际协作效果看,让 LLM 写 Python 代码,准确率更高,代码更简洁,出错更少。同样的业务逻辑,Python 版本往往比 TypeScript 版本少写一半代码,而 LLM 生成的质量也更稳定。

对创业者来说,这意味着:你用 Python 描述的业务逻辑,AI 能以最高的保真度理解和执行。 你的商业判断,通过 Python 这个媒介,被最完整地传递给了 AI。

这不是技术细节,这是创业效率的核心变量。

三、胶水语言的威力:一人公司的超级能力

Python 被称为"胶水语言",这个绰号在 AI Agent 时代变成了最高的褒奖。

一人公司面临的核心问题是:需要做的事情太多,能调用的资源太少。 你既要想产品方向,又要写代码,又要找客户,又要处理运营。任何一个环节的效率损耗,都会直接影响公司的生死。

Python 的胶水特性,让一个人可以快速把各种工具和服务组合在一起:

调用 LLM API → openai 库,3 行代码

解析和处理文本 → 原生字符串操作,5 行代码

读写本地文件 → 原生支持,1 行代码

起一个本地演示服务 → flask,5 行代码

连接云端数据库 → supabase-py,3 行代码

操作浏览器自动化 → playwright,5 行代码

定时任务调度 → schedule 库,3 行代码

每个模块 pip install 一下,然后用 Python 把它们粘在一起,一个完整的业务原型就跑起来了。

同样的事情用 TypeScript 来做,光是配置 tsconfig.json、处理模块系统、解决类型冲突,就要消耗大量时间——这些时间没有产生任何业务价值。

对一人公司来说,时间是最稀缺的资源。Python 让你把 100% 的时间花在业务逻辑上,而不是工程配置上。

四、CLI 演示:最快的客户验证路径

这是 Python 给创业者带来的最直接的竞争优势。

传统的产品验证路径:

想法 → 搭框架 → 写前端 → 写后端 → 部署上线

→ 找客户 → 发现方向错了 → 凉了

(耗时:数周到数月)

Python CLI 的验证路径:

想法 → Python 脚本跑通核心逻辑

→ 当面给客户演示 → 客户说好 → 再做产品

(耗时:数天)

想象一个真实场景:你在做一个 AI 报告生成工具。用 Python 写一个命令行脚本,输入需求,输出一个包含交互图表的 HTML 文件,浏览器直接打开就能看。整个核心逻辑可能只需要 200 行 Python 代码,一个下午跑通。

$pythongenerate.py--input"帮我分析Q1销售数据"

⏳正在生成报告...

✅报告已生成:output/report_20260317.html

🌐正在浏览器打开...

然后你带着这个脚本去见潜在客户,当场演示:输入一段需求,30 秒后浏览器弹出一份专业的交互报告。

客户的反应决定你下一步怎么走:

- 客户兴奋,愿意付费 → 再花时间做成 Web 产品

- 客户无感,需求不对 → 损失只有几天,立刻调整方向

最贵的成本不是开发时间,是方向错了还继续做。Python MVP 把试错成本压到最低。

五、前端已经商品化,思考才是护城河

理解了 Python 的价值,还需要理解另一面:前端代码正在商品化。

你对 AI 说一句话:

"帮我做一个报告预览页,左边目录右边内容,顶部有下载和打印按钮,暗色主题"

30 秒后,你得到一个完整的 Next.js 页面,Tailwind 样式,响应式布局,交互动画全部就位。以前这需要一个前端工程师花三天时间完成。

当编码执行能力的边际成本趋近于零,整个软件开发的价值体系就需要重新定价。

真正稀缺的资源变成了:

- 判断做什么方向是对的

- 设计 LLM 的提示词逻辑

- 定义数据结构和业务规则

- 理解客户的真实需求

- 决定 MVP 要验证什么假设

这些判断,全部体现在你的 Python 脚本里。

def generate_report(user_input: str) -> str:

# 你对业务场景的理解

prompt = build_prompt(user_input)

# 你反复调教 LLM 的经验积累

response = call_llm(prompt)

# 你对数据结构的设计决策

charts = parse_charts(response)

# 你对输出质量标准的定义

return render_html(charts)

前端页面随时可以让 AI 重写,但这个核心逻辑,是你反复打磨出来的真正资产。Python 脚本是你判断力的具象化,这才是 AI 时代真正的护城河。

六、正确的分工:Python 思考,TypeScript 交付

澄清一点:这篇文章不是在说 TypeScript 不重要。

TypeScript 在产品工程化阶段依然不可替代——类型安全、工程规范、团队协作,这些优势在产品交付阶段非常关键。但它的定位,已经从"核心技能"变成了"交付工具"。

对创业者来说,清晰的分工是:

| 阶段 | 工具 | 目标 |

|---|---|---|

| 验证期 | Python CLI | 用最低成本验证核心假设 |

| 产品期 | TypeScript + AI 生成前端 | 把验证过的逻辑包装成产品 |

| 增长期 | 两者结合 | Python 处理 AI 逻辑,TS 处理用户界面 |

更重要的是,Python 脚本是最好的产品文档。当你需要把 Python 原型转化为 TypeScript 产品时,你对 AI 说:

"这是我的 Python 核心逻辑,帮我转成 Next.js API Route 的 TypeScript 版本"

Python 代码比任何自然语言描述都精确 10 倍,AI 的转换质量也会高得多。Python 原型不是一次性的,它是整个产品开发过程中最有价值的参考资产。

结论

Python 成为 GitHub 第一语言,不是终点,而是一个新角色的起点。

在 AI Agent 时代,Python 完成了一次深刻的定位升级:从数据科学家的专属工具,变成了创业者与 AI 之间最经济的精确沟通语言。

对创业者和一人公司来说,这个升级带来三个核心价值:

- 降低沟通成本:Python 是自然语言和机器语言之间最经济的桥梁,用最少的符号表达最完整的商业思想,让 AI 以最高保真度理解你的意图

- 加速市场验证:Python CLI 原型可以在数天内跑通核心逻辑,当面演示给客户,把试错成本压到最低

- 聚焦核心价值:把工程配置和前端实现交给 AI,把全部精力放在业务逻辑和商业判断上——而这,才是一人公司真正的护城河

自然语言太模糊,TypeScript 噪音太多。Python 刚好在中间。

在 AI Agent 时代,Python 不是退而求其次的选择,它是创业者最聪明、最经济的选择。

参考文献

- [1] GitHub Octoverse 2024:Python 成为最流行语言: https://github.blog/news-insights/octoverse/octoverse-2024/

- [2] OpenAI Python SDK 官方文档: https://github.com/openai/openai-python

- [3] LangChain Python 框架: https://python.langchain.com/docs/introduction/

- [4] AutoGen:微软多 Agent 协作框架: https://github.com/microsoft/autogen

- [5] CrewAI:多 Agent 任务编排框架: https://github.com/crewAIInc/crewAI

- [6] Stack Overflow 2024 开发者调查报告: https://survey.stackoverflow.co/2024/

- [7] Paul Graham:做那些不可扩展的事: http://paulgraham.com/ds.html

关于 AI 智能体研究

欢迎关注“AI 智能体研究”!这里聚焦 AI 智能体前沿成果,解析技术原理,探讨应用场景。无论是技术爱好者还是行业探索者,都能获取最新资讯与深度见解。一起探索 AI 智能体的无限可能,共赴科技未来!

如果这篇文章对您有帮助,欢迎:

🌟 点赞收藏:方便日后查阅参考

📤 转发分享:让更多同行获得有价值的信息

👀 关注我们:每日获取最新资讯,不错过关键动态

您的每一次互动,都是我们持续输出优质内容的动力。