大家好,我是躺平的程序员!

传统编程模式已过时!AI 编程开发的“新王者”诞生了

OpenHands 是一个近期在 AI 编程领域迅速崛起的开源项目,凭借其创新的 AI 驱动开发模式和强大的功能集成,短时间内狂揽 60k+ Star,被开发者社区誉为“AI 编程开发的新王者”。

AI 编程工具的革命性突破

开发者需求驱动

传统编程模式依赖手动编写代码,效率受限于开发者技能和经验。随着 AI 技术的发展,AI 辅助编程工具(如 GitHub Copilot、Cursor)逐渐普及,但存在功能分散、定制化能力弱等问题。

OpenHands 的诞生旨在通过高度集成的 AI 能力,实现“自然语言到可运行代码”的无缝转换,降低编程门槛,提升开发效率。

开源生态的推动

OpenHands 遵循开源协议(如 MIT),允许开发者自由使用、修改和扩展。其代码仓库(GitHub)提供完整的实现细节,包括前端界面、后端逻辑和 AI 模型集成,吸引了大量开发者参与贡献,形成活跃的社区生态。

核心功能

AI 驱动的全流程编程体验!

自然语言编程(NL2Code)

功能描述:用户可通过自然语言描述需求(如“用 Python 写一个快速排序算法”),OpenHands 自动生成可运行的代码。

技术实现:集成大语言模型(如 GPT-4、Claude),结合代码上下文分析,确保生成的代码符合语法规范和业务逻辑。

优势:无需记忆语法细节,适合非专业开发者或快速原型开发。

多语言支持

覆盖范围:支持 Python、Java、JavaScript、C++、Go 等主流编程语言,满足不同场景需求。

扩展性:通过插件机制可快速添加新语言支持。

智能调试与优化

错误检测:自动分析代码中的潜在错误(如语法错误、逻辑漏洞),并提供修复建议。

性能优化:识别低效代码段(如循环冗余、内存泄漏),生成优化后的版本。

测试用例生成:根据代码功能自动生成测试用例,提升代码覆盖率。

项目级开发支持

全流程管理:从需求分析、代码生成、调试优化到部署上线,提供一站式解决方案。

协作功能:支持多人协同开发,通过版本控制(Git 集成)管理代码变更。

插件与扩展生态

开放接口:提供 RESTful API 和 Webhook,允许与其他工具(如 CI/CD 流水线、项目管理软件)集成。

社区插件:开发者可贡献自定义插件(如数据库连接、API 调用),丰富工具功能。

技术架构

模块化与可扩展设计!

前端界面

技术栈:基于 React/Vue 构建,提供直观的代码编辑器和交互面板。支持代码高亮、语法检查、实时预览,提升用户体验。

后端服务

AI 模型服务:通过微服务架构部署大语言模型,支持动态扩展和负载均衡。解析代码结构,提取上下文信息,辅助 AI 生成更准确的代码。

数据库:使用 PostgreSQL/MongoDB 存储项目数据、代码历史和用户配置。

AI 模型集成

模型选择:支持多种大语言模型(如 GPT-4、Llama 3),用户可根据需求切换。

模型优化:通过 Fine-tuning 技术定制模型,提升特定领域(如 Web 开发、数据分析)的代码生成质量。

部署方式

本地部署:支持 Docker 容器化部署,适合个人开发者或小团队。

云服务:提供 SaaS 版本,用户可通过网页端直接使用,无需本地环境配置。

优势分析

为何能成为“新王者”?

- 代码透明:开发者可审查代码实现,确保安全性和可靠性。

- 快速迭代:社区贡献者持续优化功能,修复漏洞,提升用户体验。

- 全流程覆盖:从需求到部署,AI 贯穿开发每个环节,减少人工干预。

- 自然语言交互:无需记忆复杂语法,适合非专业开发者。

- 模型切换:用户可根据需求选择不同 AI 模型,平衡成本和效果。

- 安全合规:提供私有化部署方案,满足企业数据安全要求。

部署使用

系统要求

- 操作系统:Linux(推荐 Ubuntu 22.04)、macOS 或 Windows(需启用 WSL2 并安装 Linux 子系统)。

- Docker 引擎:需安装 Docker Desktop(Windows/macOS)或原生 Docker 引擎(Linux)。

- Python 与 NodeJS:Python 3.12、NodeJS ≥ 20.x(部分场景需 Poetry ≥ 1.8 管理依赖)。

- 硬件配置:建议至少 4GB 内存(Windows 需为 WSL2 分配额外资源)。

Docker 安装这里不再赘述了,可以参考公众号之前推送的文章。

安装 OpenHands

拉取 OpenHands 镜像

docker pull docker.all-hands.dev/all-hands-ai/runtime:0.39-nikolaik

运行 OpenHands 容器

docker run -it --rm --pull=always \ -e SANDBOX_RUNTIME_CONTAINER_IMAGE=docker.all-hands.dev/all-hands-ai/runtime:0.39-nikolaik \ -e LOG_ALL_EVENTS=true \ -v /var/run/docker.sock:/var/run/docker.sock \ -v ~/.openhands-state:/.openhands-state \ -p 3000:3000 \ --add-host host.docker.internal:host-gateway \ --name openhands-app \ docker.all-hands.dev/all-hands-ai/openhands:0.39

使用操作

访问 OpenHands 界面

打开浏览器,输入 http://localhost:3000。

首次运行会弹出设置窗口,需配置以下信息:

- LLM 提供商:选择模型提供商(如 Anthropic 3.5 Opus、GPT-4o 或本地 Ollama 模型)。

- API 密钥:输入所选模型的 API 密钥(本地模型无需此步骤)。

- 高级选项:可手动输入自定义模型名称和 Base URL(如配置 Ollama 本地模型时需指定

http://host.docker.internal:11434)。

语言模型配置(可选)

使用本地 Ollama 模型:

安装并启动 Ollama 服务,构建自定义模型(如通过 ollama create deepseek-optimized -f Modelfile)。

在 OpenHands 设置中,将模型名称填为 ollama/deepseek-optimized:latest,基础 URL 填为 http://host.docker.internal:11434。

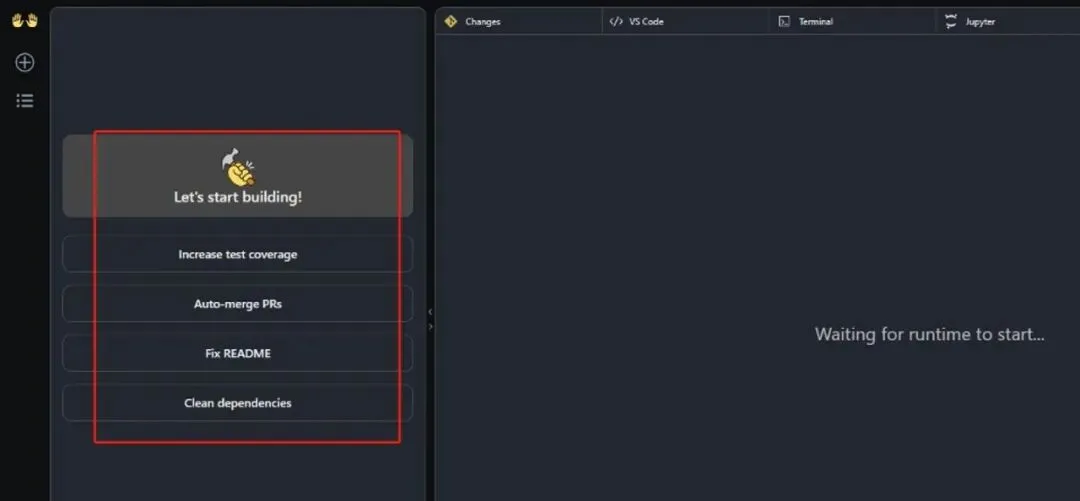

使用界面

结语

OpenHands——你的编程超级外挂!🚀 让代码从灵感迸发到完美落地,全程无需动手敲键!

它是零基础救星,不会语法?AI 边生成边解释,代码逻辑一目了然。

更是资深开发者利器,自动补全复杂逻辑、优化性能,告别重复造轮子。

新手秒变大神,老手效率翻倍!

连接 Git 仓库后,提交代码自动触发测试、构建、部署,真正实现“一键交付”。

地址:https://github.com/All-Hands-AI/OpenHands