Geo开发者的Python环境配置指南 (Pixi实战)

- 2026-03-26 13:56:15

1. 放弃 Conda,也别迷信 uv

作为地理空间(Geo)开发者,配置 Python 环境的痛,纯软件开发者很难体会。当你满怀激情敲下conda install gdal geopandas,面对Solving environment转半个小时,最后可能还是一堆 C++ 动态库版本冲突的红字。

所以当基于 Rust 的极速包管理器 uv 横空出世时,它毫秒级的解析速度让无数人高呼“告别 Conda”。但是,Geo 开发者,别急着迷信 uv。

uv 极其优秀,但它只管纯 Python 生态(PyPI)。而我们搞地理空间计算和遥感开发的,从底层的GDAL、PDAL到PROJ,灵魂全是C/C++。用 uv 下载的往往只是一层薄薄的 Python Wrapper(接口封装),如果没有系统级的底层二进制文件支持,根本跑不起来。

更致命的是,当我们做算法工程化,经常需要将高光谱影像处理算法与 C++ 软件集成,甚至自己编写 .pyd 扩展。这不仅需要算法包,还需要 CMake 和特定版本的编译器——这些非 Python 的系统级依赖,纯粹的 Python 工具 uv 统统给不了。Conda 有生态但太重太慢,uv 极快却“偏科”。

2. 破局者 Pixi:兼顾速度与底层生态的“究极形态”

我们需要一个既有 uv 的极致速度,又有 Conda 的全生态支持,还能实现真正的项目级隔离的工具。 基于 Rust 开发的包管理器 Pixi,正是完美解决所有痛点的“降维打击”者。它不造新轮子,而是做了一个极其优雅的“生态缝合怪”:

双生态融合(conda-forge + PyPI): 这是 Pixi 最具杀伤力的特性。当你需要 GDAL、CMake或C++编译器时,它以极快的速度从 conda-forge 拉取预编译底层库;需要最新的纯 Python 算法包时,又能无缝接入 PyPI 生态。列表项真正的“项目级”隔离: Conda 习惯在系统全局维护环境,一旦“变脏”只能含泪重装。Pixi 则引入了类似前端 npm的工作流,每个项目自带独立的.pixi隐藏目录和pixi.toml配置文件。环境跟着代码走,把项目发给同事,一行命令就能 100% 像素级复现,心智负担降为零。

3. 极速上手Pixi:搞定“地狱级”地理空间依赖

光说不练假把式。假设我们现在要开启一个多光谱影像预处理的新项目:需要用GDAL读取多波段 TIFF,又需要spectral辅助来编写辐射校正算法。

3.1 安装Pixi

不论是 Windows 还是 macOS/Linux,一行命令即可搞定(Pixi 本身就是一个极小的独立二进制文件):

# macOS / Linuxcurl -fsSL https://pixi.sh/install.sh | sh# Windows (注意是管理员身份打开PowerShell命令窗口)irm -useb https://pixi.sh/install.ps1 | iex执行这个命令会从官方网站获取安装脚本,自动下载安装Pixi,同时为我们配置好环境变量,当然我们也可以指定一些配置参数进行自定义安装。

参数说明:

PIXI_VERSION:此参数可以指定要安装的Pixi程序的具体版本号。PIXI_HOME:此参数代表Pixi 存放全局数据的主干目录。PIXI_NO_PATH_UPDATE:此参数是控制Pixi 的系统环境变量的。PIXI_DOWNLOAD_URL:此参数用来自定义 Pixi 二进制安装包的下载源。

举个例子,假设我的系统环境是Windows,我想安装v0.65.0版本的Pixi,全局安装路径指定为D:\PS\Pixi,系统环境变量指定为D:\PS\Pixi,同时自定义一个下载源,那么我安装命令可修改为下面这样:

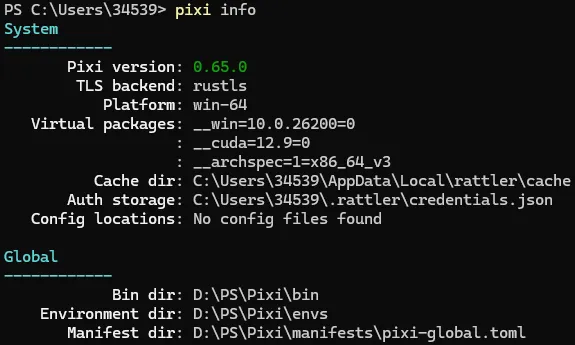

env:PIXIVERSION=′v0.65.0′;env:PIXI_HOME='D:\PS\Pixi'; env:PIXINOPATHUPDATE=′D:\PS\Pixi′;env:PIXI_DOWNLOAD_URL='你的真实下载地址'; irm -useb https://pixi.sh/install.ps1 | iex我们可以在PowerShell命令窗口中输入pixi info检查是否安装成功,出现以下类似信息则安装成功:

3.2 配置镜像源(具备科学上网能力可忽略)

Pixi 最大的优势之一就是它基于 Rust 的毫秒级依赖解析引擎。如果在解析完复杂的依赖树后,下载环节却因为网络问题卡了半小时,那 Pixi 的速度优势就完全丧失了。所以“Pixi 的极速引擎 + 国内镜像源的极速下载”,才是国内Geo开发者配置开发环境的最优方案。

我们在前面设置的PIXI_HOME目录(例如我前面设置的D:\PS\Pixi)下新建一个config.toml文件,内容可按如下配置:

[mirrors]"https://conda.anaconda.org/conda-forge" = ["https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud/conda-forge"]"https://repo.anaconda.com/pkgs/main" = ["https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/main"]"https://repo.anaconda.com/pkgs/free" = ["https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/free"]"https://repo.anaconda.com/pkgs/r" = ["https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/r"]"https://repo.anaconda.com/pkgs/msys2" = ["https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/msys2"][pypi-config]index-url = "https://pypi.tuna.tsinghua.edu.cn/simple"extra-index-urls = ["https://mirrors.tuna.tsinghua.edu.cn/pypi/web/simple"]3.3 创建项目工作区

首先在PowerShell命令窗口中cd到一个目录下(我这里在桌面创建工作区),接着用pixi init命令来创建和初始化我多光谱影像预处理项目的工作区:

cd C:\Users\34539\Desktoppixi init spectral-processingcd C:\Users\34539\Desktop\spectral-processing此时,会发现桌面生成一个名为“spectral-processing”的文件夹(也就是多光谱影像预处理项目的工作区),文件夹内有三个文件,结构如下:

spectral-processing├── .gitattributes├── .gitignore└── pixi.toml前两个是git的配置文件,其中pixi.toml文件是工作区的配置文件。它包含有关工作区的所有信息,例如其通道、平台、依赖项、任务等等,基本内容格式如下:

[workspace]channels = ["conda-forge"]name = "spectral-processing"platforms = ["win-64"]version = "0.1.0"[dependencies][tasks]3.4 秒装“地理全家桶”

在Pixi中,我们使用pixi add命令向pixi.toml配置文件中添加依赖项:

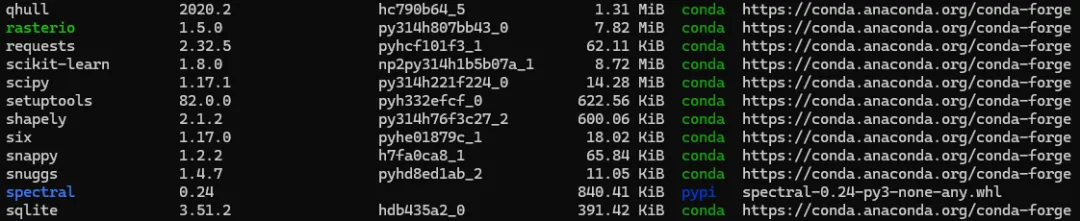

# 从 conda-forge 拉取多个沉重的底层 GIS 库pixi add gdal geopandas rasterio# 从 PyPI 拉取纯 Python 算法包(比如处理光谱数据的包)pixi add --pypi spectral你会看到,极其复杂的 C++ 动态链接库依赖树在几秒钟内被理清,并飞速下载到项目的工作空间中,我们可以使用pixi list命令查看依赖的安装情况: 也可以使用

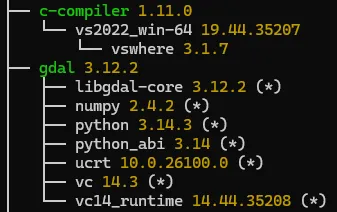

也可以使用pixi tree命令查看当前环境中的依赖关系树: 还可以使用

还可以使用pixi update命令更新pixi.toml配置文件中删除某些依赖项,甚至使用pixi upgrade命令进行更激进的依赖更新。这里解释一下pixi update和pixi upgrade的区别:

pixi update(保守更新): 只更新pixi.lock锁文件。它会在你pixi.toml规定的版本范围内,寻找最新的包。它绝不会修改你的 pixi.toml。pixi upgrade(激进升级): 同时更新pixi.toml和pixi.lock。它会无视(并重写)你原本写在配置文件里的版本限制,直接强行升级到当前的绝对最新版。

3.5 优雅的 Task 管理

经过上面一番操作后,此时再打开生成的pixi.toml,你会发现一切井井有条。更赞的是,Pixi 支持像Makefile一样定义任务。

我们可以把运行辐射校正算法脚本的任务直接写进去:

[workspace]channels = ["conda-forge"]name = "spectral-processing"platforms = ["win-64"]version = "0.1.0"[dependencies]gdal = ">=3.12.2,<4"geopandas = ">=1.1.2,<2"rasterio = ">=1.5.0,<2"cmake = ">=4.2.3,<5"c-compiler = ">=1.11.0,<2"cxx-compiler = ">=1.11.0,<2"[pypi-dependencies]spectral = ">=0.24, <0.25"[tasks]# 定义快捷命令:运行辐射校正算法process = "python radiometric_correction.py"后续,我们只需要在终端优雅地敲下:

pixi run processPixi 会自动运行辐射校正算法。没有任何依赖报错,只有流畅的代码执行。

4. Pixi进阶配置

4.1 环境配置

4.1.1 概念理解

相信很多Geo开发者都是从 Conda 转过来的,那么可能最不适应的就是 Pixi 的环境管理逻辑。因为 Conda 的逻辑是把“项目环境”和“全局工具”混为一谈的,而 Pixi 采用了软件工程中“关注点分离”的架构思路,把它们拆分成了Multi Environment和Global Tools。

4.1.1.1 Conda 的方式:混乱的“大锅饭”与“合租房”

在 Conda 中,你敲下conda create -n my_env,这个环境会被统一塞进系统的全局目录(比如C:\miniconda3\envs\my_env)。

痛点 1(环境与代码脱节): 你的代码在 D:\Project,环境在C:\miniconda3。当你把代码拷给别人时,环境带不走,只能手动导出一个极易报错的environment.yml。痛点 2(工具污染环境): 假设你需要用 JupyterLab写代码,用Black格式化代码。在 Conda 里,你通常只能把这些工具conda install到你的my_env业务环境里。这会导致你的业务依赖树变得极其臃肿,甚至因为Jupyter的某个底层包冲突,把你原本好好的GDAL给搞崩了。

4.1.1.2 Pixi 的 Multi Environment(多环境):项目内的“平行宇宙”

Multi Environment是严格绑定在单个项目工作区(文件夹)内部的。它解决的是:“同一个代码库,在不同开发阶段或场景下,需要不同依赖组合”的问题。

核心逻辑:像搭积木一样组合环境。在 Pixi 中,你不需要为同一个项目建好几个隔离的文件夹。你可以定义不同的 [feature](特性积木),然后拼装成不同的环境。实战场景:假设你在做一个高光谱图像目标识别项目。 日常处理数据(轻量): 只需要 GDAL和Geopandas。你可以定义一个default环境。训练模型(极重): 需要额外加上几 GB 大小的 PyTorch和CUDA库。你可以定义一个cuda积木。

在pixi.toml里,Pixi 会在项目的.pixi/envs目录下为你生成两个平行的子环境:一个是纯 CPU 的轻量环境,一个是挂载了 GPU 的重型环境。代码只有一份,敲pixi run -e default脚本或者pixi run -e cuda就能瞬间切换运行。环境跟着代码走,绝不乱跑。

4.1.1.3 Pixi 的 Global Tools(全局工具):绝对隔离的“系统工具箱”

Global Tools是脱离具体项目,直接安装在系统层面(PIXI_HOME)的。它解决的是:我只需要这个工具的命令行功能,绝对不想让它弄脏我的业务代码环境。

核心逻辑:每个工具住在一个独立的“绝对隔离舱”。 实战场景:作为Geo开发者,你肯定希望在任何文件夹里打开终端,敲下 jupyter lab就能弹出一个记事本,或者敲下black就能格式化代码。 如果你用pixi global install jupyterlab:Pixi 会在 PIXI_HOME/envs/jupyterlab下给它单独建一个虚拟环境(只有它自己运行需要的包)。然后把启动命令 jupyter软链接到系统的 PATH 里。

结果就是: 你的系统里多了一个随叫随到的全局jupyter命令,但你的系统 Python 环境和各个项目的业务环境依然干干净净,互不干扰。就算 Jupyter 的环境崩了,也绝对影响不到你正在开发的高光谱项目。

4.1.2 具体配置方法

4.1.2.1 玩转全局工具 (Global Tools):打造绝对干净的随身工具箱

作为Geo开发者,我们经常需要用到 JupyterLab 来写交互式的数据探索代码,或者用 Black 来做代码格式化。按照以前的习惯,你可能会直接conda install jupyterlab到系统里,但可能有引发依赖冲突的风险。在Pixi 中我们可以使用极其优雅的global命令。

(1)一键安装全局工具

打开你的 PowerShell(无论在哪个目录下都可以),敲下:

# 全局安装 JupyterLab 记事本pixi global install jupyterlab# 全局安装 Black 代码格式化工具pixi global install black(2)背后发生了什么?

还记得我们在安装 Pixi 时设置的PIXI_HOME='D:\PS\Pixi'吗?当你执行上述命令后,Pixi 会在D:\PS\Pixi\envs\目录下,专门为jupyterlab和black各自建立一个绝对封闭的独立环境,并把启动命令(快捷方式)安全地映射到你的系统 PATH 中。

(3)如何使用?

安装完成后,你在电脑上的任何文件夹里打开终端,只要输入:

jupyter lab就能瞬间唤起 Jupyter 记事本。它既能随叫随到,又绝对不会弄脏你任何一个项目的依赖环境。

如果你想查看自己装了哪些全局工具,或者想卸载它们,只需使用:

# 查看安装哪些全局工具pixi global list# 删除指定的全局工具pixi global remove jupyterlab4.1.2.2 搭建高级多环境 (Multi Environment):像搭积木一样管理虚拟环境

假设我们的“多光谱影像预处理项目”需求升级了:我们不仅需要用 GDAL 做基础的图像读写与辐射校正,现在还要引入 PyTorch 来训练一个光谱图像的深度学习分割模型。

如果把庞大的 CUDA 库和轻量的 GDAL 揉在一个环境里,每次跑基础预处理脚本都会极其笨重。Pixi 给出的解法是前面提到的“特征(Feature)积木”。

(1)定义“积木块”(Features)

我们将依赖拆分成基础处理和深度学习两块,这里有两种方法,第一种是打开项目根目录下的pixi.toml文件,我们手动对它进行改造:

[workspace]channels = ["conda-forge"]name = "spectral-processing"platforms = ["win-64"]version = "0.1.0"# --- 积木 1:基础依赖(默认特性) ---[dependencies]gdal = ">=3.12.2,<4"geopandas = ">=1.1.2,<2"rasterio = ">=1.5.0,<2"# --- 积木 2:深度学习依赖(定义一个名为 ml 的新特性) ---# 注意:PyTorch 推荐从专门的 pytorch 和 nvidia 频道拉取[feature.ml.dependencies]pytorch = "*"torchvision = "*"pytorch-cuda = "11.8"[feature.ml]channels = ["pytorch", "nvidia", "conda-forge"]第二种方法是通过执行下面命令来对pixi.toml文件进行改造:

pixi add --feature ml "pytorch" "torchvision" "pytorch-cuda"(2)拼装“环境”(Environments)

有了积木块(Features),我们就可以拼装出不同的环境,这里有两种方法,第一种是打开项目根目录下的pixi.toml文件,我们手动对它进行改造:

[environments]# 默认环境:只包含积木 1(基础依赖),极其轻量,秒级启动default = ["default"] # 训练环境:把积木 1 和积木 2 拼在一起,包含 GPU 算力全家桶training = ["default", "ml"]第二种方法是通过执行下面命令来对pixi.toml文件进行改造:

# 拼装出默认环境:只包含积木 1(基础依赖),极其轻量,秒级启动pixi workspace environment add default --feature default# 拼装出训练环境:把积木 1 和积木 2 拼在一起,包含 GPU 算力全家桶pixi workspace environment add training --feature defaultpixi workspace environment add training --feature ml(3)优雅地运行任务

配置好之后,你的项目里其实就潜伏着两个平行环境了。

当你想跑轻量的预处理脚本时,直接用默认环境(两种方法):

# 默认使用 default 环境执行脚本(第一种方法)pixi run python radiometric_correction.py# 也可以先激活 default 环境,再执行脚本(第二种方法)pixi shell -e default python radiometric_correction.py当你想火力全开,训练深度学习模型时,只需加一个-e(environment)参数切换到重型环境(两种方法):

# 直接使用包含了 PyTorch 和 CUDA 的 training 环境执行脚本(第一种方法)pixi run -e training python train_model.py# 也可以先激活包含了 PyTorch 和 CUDA 的 training 环境,再执行脚本(第二种方法)pixi shell -e trainingpython train_model.py很多习惯了 Conda 的开发者,第一反应永远是敲conda activate来激活环境,其实我们上面使用的pixi shell命令和conda activate效果是一样的。

4.1.2.3 在 VS Code 中无缝接入 Pixi 环境

上面我们介绍了如何在终端里跑脚本,但是相信很多开发者常用的IDE是VS Code,打开 VS Code 编辑器,发现from osgeo import gdal下面画满了红色的波浪线,没有任何代码补全提示。

这是因为 VS Code 默认去读取了你电脑系统的 Python,根本不知道 Pixi 把环境藏在了哪里。

解决方法很简单:告诉 VS Code 那个藏起来的python.exe在哪。Pixi 所有的项目环境,都物理隔离在项目工作区根目录的.pixi/envs/文件夹下。

具体操作步骤如下:

(1)用 VS Code 打开你的项目工作区文件夹。

(2)按下键盘快捷键Ctrl + Shift + P打开命令面板。

(3)输入并选择Python: Select Interpreter(Python: 选择解释器)。

(4)在弹出的列表中,点击Enter interpreter path...(输入解释器路径...),然后点击Find...(查找...)。

(5)在弹出的文件选择窗口中,依次进入你项目中的隐藏目录,找到它:.pixi\envs\default\python.exe(如果你想使用刚才配置的深度学习多环境,就把default换成training文件夹)

选中之后,看一眼 VS Code 的右下角,你会发现 Python 版本号变了。此时,GDAL 的底层 C++ 接口提示、PyTorch 的张量补全,全部瞬间复活!以后每次打开这个项目,VS Code 都会自动连上这个环境,再也不用折腾了。

4.2 环境复用

到这里,我们已经完全掌握了 Pixi 的环境隔离精髓。那么怎么在其它电脑上进行环境复用呢?

4.2.1 核心机制:神圣不可侵犯的 pixi.lock 文件

当你用 Pixi 安装依赖时(比如执行了pixi add gdal),项目目录下除了pixi.toml,还会自动生成一个叫pixi.lock的文件。

pixi.toml(需求清单): 就像是说“我需要买点西红柿和鸡蛋”。pixi.lock(锁文件): 则是一份极其变态的精确清单:“必须是某年某月某日产自特定农场的普罗旺斯西红柿编号 #1234,以及带有特定溯源哈希值的鸡蛋”。

这个锁文件会把 GDAL 底层依赖的几百个 C/C++ 二进制包的绝对精确版本号、下载地址、甚至文件的哈希值(唯一身份证)全部记录下来。

4.2.2 具体配置方法

复用环境,你只需要遵循以下两步极其简单的操作:

第一步:分享(或者提交到 Git)你只需要把你的代码、pixi.toml和pixi.lock这三个东西打包拷贝到另一台电脑,或者推送到 GitHub/GitLab。(注意:不需要、也绝不能把几十个 G 的.pixi隐藏文件夹拷贝到另一台电脑,pixi init早就贴心地帮我们把.pixi写进.gitignore忽略名单里了)。

第二步:复现(另一台电脑的操作)拷贝后,只需要在他的电脑终端里,进入项目工作区目录,敲下一行命令:

pixi install执行命令后Pixi 根本不需要再去费时费力地“Solving environment”了。它会直接掏出那份pixi.lock锁文件,照方抓药,以最快的速度把每一个特定版本的底层包拉取下来。另一台电脑上即会完成环境的100%复刻。

5. 总结

工具的迭代,本质上是为了释放开发者的创造力。

作为Geo开发者,我们的核心价值在于设计更高效的空间计算模型、构建先进的遥感算法,并将算法稳健地工程化落地。我们宝贵的生命,绝对不应该浪费在无尽的Solving environment转圈圈和底层动态库的红字报错中。

放弃臃肿的 Conda,避开偏科的 uv。如果你也是一名深受环境依赖折磨的 Geo 开发者,去试试 Pixi 吧,它绝对是现阶段空间计算与混合编译架构下,最完美的终极解法。

你在配置GIS或遥感开发环境时,还踩过什么令人抓狂的大坑?平时主要用 Python 处理哪些空间数据?欢迎在评论区吐槽交流!