引言

看了那么多AI理论,却不知如何动手写第一行代码?今天,我们直接跳过概念讲解,带你完成一个完整的AI项目——花朵分类。你只需要一台电脑,跟着步骤操作,60分钟内就能看到自己训练的AI模型如何准确区分三种不同的花朵。

这不仅是你的第一个AI项目,更是你从“观看者”变为“实践者”的关键一步。让我们开始实战!

第一部分:为什么Python是AI第一语言?

Python之所以成为AI领域的“普通话”,主要因为三个优势:

生态丰富:Python社区提供了完整的AI工具箱。NumPy处理数据比传统列表快100倍,Pandas让你像操作Excel一样处理表格,scikit-learn包含了所有经典机器学习算法。你不需要从零造轮子,只需学会组装这些成熟组件。

语法友好:Python代码读起来像自然语言。比如如果 温度 > 30: 打印("今天很热"),这种低门槛让初学者能更快聚焦AI逻辑本身。

职场刚需:打开任意AI招聘要求,Python几乎是必备技能。掌握Python+scikit-learn组合,你就能胜任大多数初级机器学习工程师的数据建模工作。

第二部分:环境准备(3分钟完成)

2.1 安装Anaconda

访问Anaconda官网,下载对应系统版本(Windows/Mac/Linux),双击安装即可。安装后打开命令行验证:

python --version

显示“Python 3.x.x (Anaconda)”即成功。

2.2 所需库介绍

本项目需要以下核心库,你可以通过pip install numpy pandas scikit-learn matplotlib seaborn一键安装:

NumPy:高效数值计算

Pandas:数据处理与分析

scikit-learn:机器学习算法

Matplotlib/Seaborn:数据可视化

第三部分:认识花朵数据

鸢尾花数据集是机器学习领域的入门数据集,可以自行搜索一下该数据集,里面有150组测量数据。

3.1 数据规律观察

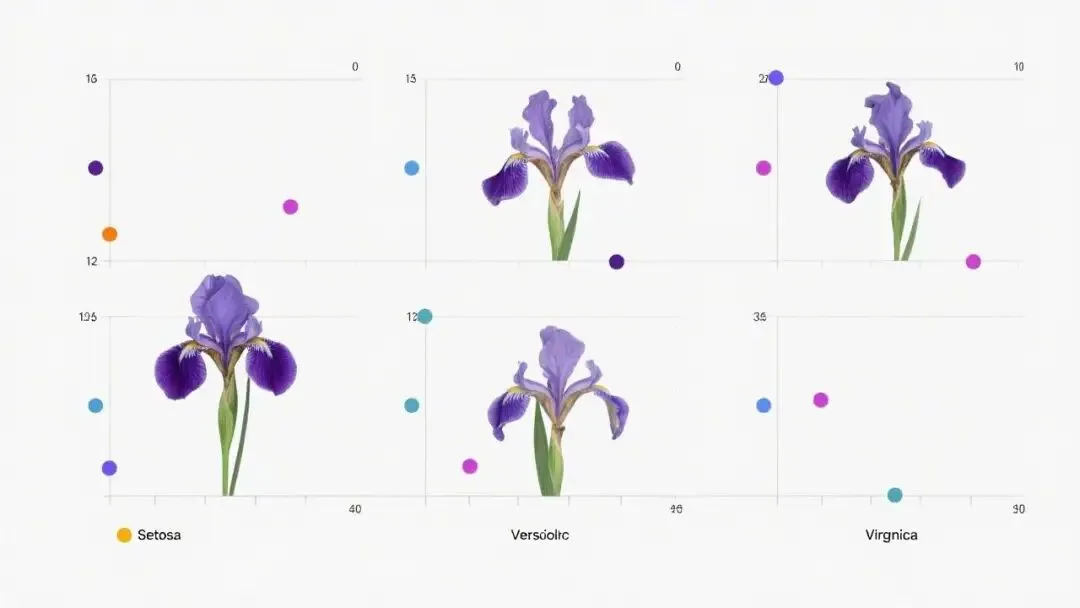

通过数据可视化可以发现:setosa品种在几乎所有特征组合中都与其他两类明显分开。

数据特征散点图矩阵

这说明分类任务不会太难——这正是选择该数据集作为入门项目的原因。

第四部分:为什么选择逻辑回归?

面对分类问题,为什么我选择了逻辑回归作为你的第一个模型?

简单但强大:逻辑回归先计算每个样本属于各个类别的“概率得分”,然后选择概率最高的类别。就像老师批改选择题,估算学生选A、B、C的可能性,判断最终答案。

训练速度快:对于150个样本的小数据集,训练时间<0.1秒,让你能快速迭代。

结果可解释:每个特征都有明确的权重,权重大小代表该特征对分类结果的影响程度。

对比其他算法:决策树容易过拟合,支持向量机参数敏感,K近邻计算量大。逻辑回归是平衡简单性、速度、效果的最佳入门选择。

第五部分:核心代码实现

下面是精简后的核心代码,聚焦于数据准备、模型训练与评估:

# =========== 1. 数据准备 =========== from sklearn.datasets import load_iris from sklearn.model_selection import train_test_split 数据集 = load_iris() X = 数据集.data # 特征矩阵 y = 数据集.target # 目标标签 # 划分训练集(80%)和测试集(20%) X训练, X测试, y训练, y测试 = train_test_split( X, y, test_size=0.2, random_state=42, stratify=y ) print(f"训练集:{X训练.shape[0]}个样本,测试集:{X测试.shape[0]}个样本") # =========== 2. 模型训练 =========== from sklearn.linear_model import LogisticRegression 模型 = LogisticRegression(max_iter=200, random_state=42) 模型.fit(X训练, y训练) print("模型训练完成!") # =========== 3. 预测与评估 =========== 预测结果 = 模型.predict(X测试) from sklearn.metrics import accuracy_score, classification_report 准确率 = accuracy_score(y测试, 预测结果) print(f"模型准确率:{准确率:.2%}") print("\n详细评估报告:") print(classification_report(y测试, 预测结果, target_names=数据集.target_names)) # =========== 4. 特征重要性分析 =========== print("\n特征权重(数值越大,影响力越强):") 特征权重 = 模型.coef_ for 类别索引, 类别名 in enumerate(数据集.target_names): print(f"\n{类别名}:") for 特征索引, 特征名 in enumerate(数据集.feature_names): 权重 = 特征权重[类别索引, 特征索引] print(f" {特征名}: {权重:.3f}")

第六部分:结果分析与可视化

6.1 模型表现

运行上述代码,你会得到类似输出:

- 准确率:96.67%(30个测试样本中可能错1个)

- 每个类别的精确率、召回率都在90%以上

6.2 决策边界可视化

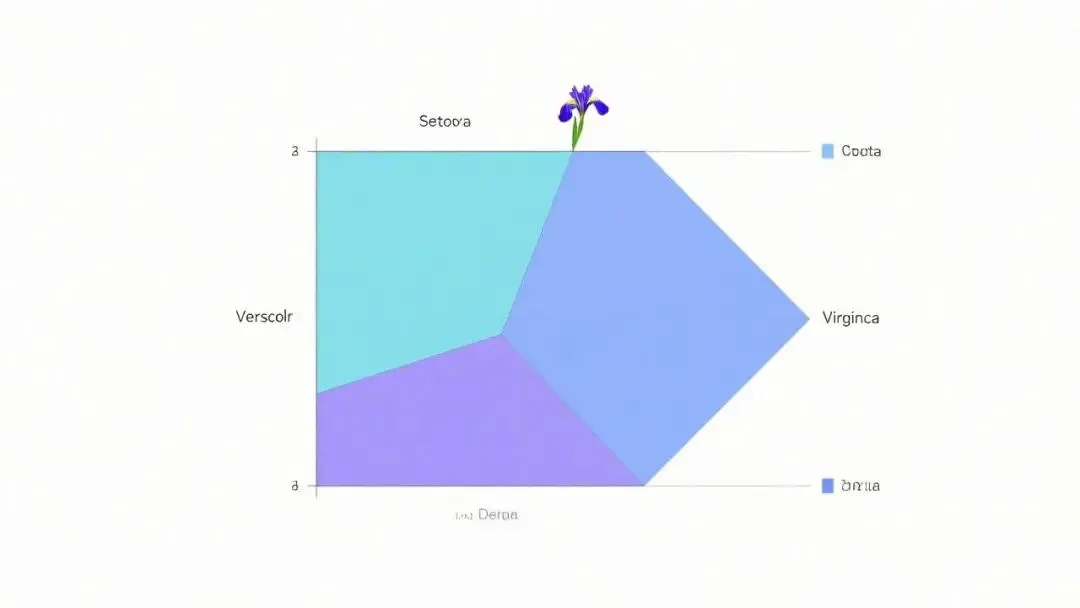

为了直观理解模型如何分类,我们绘制决策边界图:

鸢尾花分类决策边界

这张图显示不同类别的决策区域,可以看到setosa品种区域与其他两类完全分开,而versicolor和virginica之间有一些重叠——这正是模型可能犯错的地方。

6.3 核心发现

通过特征权重分析,你会发现:花瓣长度和花瓣宽度对分类的贡献最大,这与我们的视觉观察一致。

第七部分:扩展练习

完成第一个项目后,你可以尝试以下拓展方向:

7.1 换个数据集:挑战葡萄酒分类数据集(load_wine()),重复上述流程。

7.2 换个算法:用相同数据试试K近邻、决策树、支持向量机等其他算法,比较效果差异。

7.3 增加难度:挑战手写数字识别(MNIST数据集),测试逻辑回归在多类别问题上的表现。

结语

回顾今天的学习旅程:你从零开始,搭建环境、探索数据、选择模型、训练评估,最终得到了一个准确率超过96%的鸢尾花分类器。

最重要的不是代码本身,而是你走通的这个完整流程:

1. 理解问题 → 2. 准备数据 → 3. 选择工具 → 4. 训练模型 → 5. 评估效果 → 6. 迭代拓展

这个流程适用于80%的机器学习项目。下次当你面对新的AI任务时,只需把今天学习用的花朵数据换成你的业务数据,同样的步骤就能产生价值。

记住,学习AI最好的方式不是看100篇教程,而是动手完成1个项目。今天你迈出了第一步,接下来要保持这个节奏——每周实践一个项目,三个月后回头看,你会惊讶于自己的成长。

你的下一个任务:在评论区分享你运行代码的结果,或者提出遇到的问题。我会选取典型问题进行解答。