装饰器(Decorator)是Python中一种强大而优雅的语法特性,它允许我们在不修改函数或类本身的情况下,动态地为其添加新的功能。装饰器本质上是一个可调用对象(通常是函数或类),它接受一个函数作为输入,并返回一个新的函数(或修改后的原函数)。在深度学习领域,装饰器被广泛应用于性能优化、代码复用、调试监控等场景。本文将系统全面地介绍Python装饰器的原理、用法,并结合深度学习框架(如PyTorch)展示实际应用。

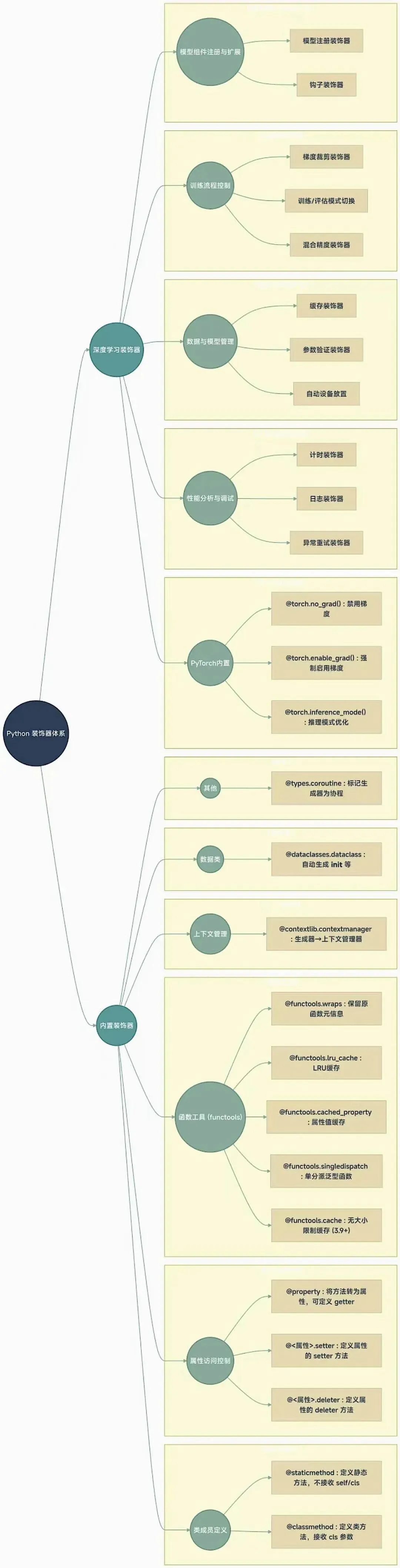

Python装饰器体系├── 内置装饰器│ ├── 类成员定义│ │ ├── @staticmethod # 定义静态方法,不接收self/cls│ │ └── @classmethod # 定义类方法,接收cls参数│ ├── 属性访问控制│ │ ├── @property # 将方法转为只读属性│ │ ├── @<属性>.setter # 定义属性的赋值逻辑│ │ └── @<属性>.deleter # 定义属性的删除逻辑│ ├── 函数工具 (functools)│ │ ├── @functools.wraps # 保留原函数元信息│ │ ├── @functools.lru_cache # LRU缓存函数结果│ │ ├── @functools.cached_property # 属性值缓存,只计算一次│ │ ├── @functools.singledispatch # 单分派泛型函数│ │ └── @functools.cache # 无大小限制的缓存(Python3.9+)│ ├── 上下文管理│ │ └── @contextlib.contextmanager # 生成器转上下文管理器│ ├── 数据类│ │ └── @dataclasses.dataclass # 自动生成__init__等方法│ └── 其他│ └── @types.coroutine # 将生成器标记为协程(旧式)│└── 深度学习装饰器 ├── PyTorch内置 │ ├── @torch.no_grad() # 禁用梯度计算(推理/评估) │ ├── @torch.enable_grad() # 强制启用梯度 │ └── @torch.inference_mode() # 纯推理优化模式(≥1.9) ├── 性能分析与调试 │ ├── 计时装饰器 # 测量函数执行耗时 │ ├── 日志装饰器 # 记录调用参数和返回值 │ └── 异常重试装饰器 # 函数失败自动重试 ├── 数据与模型管理 │ ├── 缓存装饰器 # 预处理结果缓存(如lru_cache) │ ├── 参数验证装饰器 # 检查输入张量形状/类型 │ └── 自动设备放置 # 将输入/模型移至指定设备 ├── 训练流程控制 │ ├── 梯度裁剪装饰器 # 自动裁剪梯度防止爆炸 │ ├── 训练/评估模式切换 # 自动切换model.train/eval │ └── 混合精度装饰器 # 应用AMP自动混合精度训练 └── 模型组件注册与扩展 ├── 模型注册装饰器 # 将类注册到全局字典便于动态创建 └── 钩子装饰器 # 为模型层注册前向/反向钩子

1. 装饰器基础

1.1 函数即对象

在Python中,函数是一等公民,这意味着:

defgreet(name):returnf"Hello, {name}!"# 将函数赋值给变量say_hello = greetprint(say_hello("Alice")) # 输出: Hello, Alice!

1.2 装饰器的本质

装饰器就是一个接受函数并返回新函数的函数(或类)。它可以在不修改原函数代码的情况下,增加额外的行为。

基本形式:

defdecorator(func):defwrapper(*args, **kwargs):# 在原函数执行前添加额外操作 result = func(*args, **kwargs) # 调用原函数# 在原函数执行后添加额外操作return resultreturn wrapper

1.3 语法糖 @

使用 @decorator_name 语法可以更简洁地应用装饰器:

@decoratordefmy_function():pass

等价于:

defmy_function():passmy_function = decorator(my_function)

1.4 第一个装饰器示例

下面是一个简单的计时装饰器,用于测量函数执行时间:

import timedeftimer(func):defwrapper(*args, **kwargs): start = time.time() result = func(*args, **kwargs) end = time.time() print(f"{func.__name__} 执行耗时: {end - start:.4f}秒")return resultreturn wrapper@timerdefslow_function(): time.sleep(2)return"完成"slow_function() # 输出: slow_function 执行耗时: 2.0012秒

1.5 保留原函数元信息(functools.wraps)

装饰器返回的 wrapper 函数会覆盖原函数的元信息(如 __name__、__doc__ 等)。使用 functools.wraps 可以解决这个问题:

import functoolsdeftimer(func): @functools.wraps(func)defwrapper(*args, **kwargs):# ... 相同代码return resultreturn wrapper@timerdefslow_function():"""这是一个被计时装饰的函数""" time.sleep(2)print(slow_function.__name__) # 输出: slow_function (而不是wrapper)print(slow_function.__doc__) # 输出: 这是一个被计时装饰的函数

2. 带参数的装饰器

如果装饰器本身需要接受参数(例如指定日志级别、超时时间等),则需要再嵌套一层函数,形成三层结构:

defrepeat(num_times):defdecorator(func): @functools.wraps(func)defwrapper(*args, **kwargs):for _ in range(num_times): result = func(*args, **kwargs)return resultreturn wrapperreturn decorator@repeat(3)defgreet(name): print(f"Hello, {name}")greet("Bob") # 打印三次 "Hello, Bob"

执行顺序:repeat(3) 返回 decorator,然后 @decorator 应用到 greet 上。

3. 多个装饰器的叠加

多个装饰器可以同时应用,执行顺序从下往上(靠近函数的装饰器先执行),但包装顺序是从内到外。

defbold(func):defwrapper():return"<b>" + func() + "</b>"return wrapperdefitalic(func):defwrapper():return"<i>" + func() + "</i>"return wrapper@bold@italicdefgreet():return"Hello"print(greet()) # 输出: <b><i>Hello</i></b>

执行流程:greet 先被 italic 装饰,返回的函数再被 bold 装饰。

4. 类装饰器

除了函数装饰器,还可以使用类作为装饰器。类装饰器必须实现 __call__ 方法,使其实例可调用。

classCountCalls:def__init__(self, func): functools.update_wrapper(self, func) # 类似 wraps self.func = func self.count = 0def__call__(self, *args, **kwargs): self.count += 1 print(f"调用次数: {self.count}")return self.func(*args, **kwargs)@CountCallsdefsay_hi(): print("Hi!")say_hi() # 调用次数: 1say_hi() # 调用次数: 2

类装饰器适合需要维护状态的场景。

5. Python内置装饰器

Python提供了几个常用的内置装饰器,主要用于面向对象编程。

5.1 @staticmethod

将方法定义为静态方法,不接收实例(self)或类(cls)作为第一个参数。

classMath: @staticmethoddefadd(x, y):return x + yprint(Math.add(3, 5)) # 8

5.2 @classmethod

定义类方法,接收类作为第一个参数(通常命名为 cls),常用于工厂方法。

classPerson:def__init__(self, name): self.name = name @classmethoddeffrom_birth_year(cls, name, year): age = 2025 - yearreturn cls(name) # 注意这里用 cls 而不是 Person,支持继承p = Person.from_birth_year("Alice", 1995)

5.3 @property

将方法转换为属性,允许使用点号访问,并可定义 getter/setter/deleter。

classCircle:def__init__(self, radius): self._radius = radius @propertydefradius(self):return self._radius @radius.setterdefradius(self, value):if value < 0:raise ValueError("半径不能为负") self._radius = value @propertydefarea(self):return3.14 * self._radius ** 2c = Circle(5)print(c.area) # 78.5c.radius = 10# 调用 setter

5.4 @functools.lru_cache

实现最近最少使用(LRU)缓存,对函数结果进行记忆化,特别适合计算密集或重复调用的函数。

import functools@functools.lru_cache(maxsize=128)deffibonacci(n):if n < 2:return nreturn fibonacci(n-1) + fibonacci(n-2)print(fibonacci(40)) # 快速返回结果

6. 深度学习中的常用装饰器

在深度学习(尤其是PyTorch)编程中,装饰器广泛用于简化代码、控制梯度、性能分析、注册组件等场景。

6.1 PyTorch 上下文装饰器

6.1.1 @torch.no_grad()

在推理或评估阶段,禁用梯度计算,减少内存消耗并加速计算。

import torchimport torch.nn as nnmodel = nn.Linear(10, 2)x = torch.randn(5, 10)@torch.no_grad()defpredict(model, x):return model(x)output = predict(model, x) # 此过程中不会构建计算图

等价于 with torch.no_grad(): 上下文管理器。

6.1.2 @torch.enable_grad()

强制启用梯度计算(即使在 no_grad 上下文中)。

@torch.enable_grad()deftrain_step(model, x, y): loss = nn.functional.mse_loss(model(x), y) loss.backward()

6.1.3 @torch.inference_mode()(PyTorch 1.9+)

比 no_grad 更激进的优化,完全禁用梯度跟踪和相关视图,适用于纯推理。

@torch.inference_mode()definference(model, x):return model(x)

6.2 自定义性能分析装饰器

在训练过程中,经常需要监控各个步骤的耗时。

import timeimport functoolsdeftiming(func): @functools.wraps(func)defwrapper(*args, **kwargs): start = time.perf_counter() result = func(*args, **kwargs) end = time.perf_counter() print(f"{func.__name__} took {end - start:.4f}s")return resultreturn wrapper@timingdeftrain_epoch(model, dataloader, optimizer):# 训练代码pass

6.3 日志记录装饰器

自动记录函数调用参数和返回值,便于调试。

deflog_call(func): @functools.wraps(func)defwrapper(*args, **kwargs): print(f"Calling {func.__name__} with args={args}, kwargs={kwargs}") result = func(*args, **kwargs) print(f"{func.__name__} returned {result}")return resultreturn wrapper@log_calldefload_data(path):# 假设加载数据returnf"data from {path}"

6.4 缓存装饰器(自定义或使用 lru_cache)

对于数据加载或预处理函数,使用缓存避免重复计算。

import functools@functools.lru_cache(maxsize=10)defpreprocess_image(path):# 假设读取并预处理图像 print(f"Preprocessing {path}")returnf"processed {path}"# 第二次调用相同路径时直接返回缓存结果

6.5 参数验证/类型检查

确保输入符合预期,尤其在数据加载或模型前向传播前。

defvalidate_input(func): @functools.wraps(func)defwrapper(tensor, *args, **kwargs):ifnot torch.is_tensor(tensor):raise TypeError("输入必须是 torch.Tensor")if tensor.dim() != 4:raise ValueError("输入必须是4维张量 (batch, channel, H, W)")return func(tensor, *args, **kwargs)return wrapper@validate_inputdefforward(self, x):return self.model(x)

6.6 自动设备放置

将模型或张量自动移动到指定设备(GPU/CPU),简化代码。

defto_device(device="cuda"):defdecorator(func): @functools.wraps(func)defwrapper(*args, **kwargs): new_args = [arg.to(device) if torch.is_tensor(arg) else arg for arg in args] new_kwargs = {k: v.to(device) if torch.is_tensor(v) else v for k, v in kwargs.items()} result = func(*new_args, **new_kwargs)if torch.is_tensor(result): result = result.to(device)return resultreturn wrapperreturn decorator@to_device(device="cuda")defprocess_tensor(x, y):return x + y

6.7 模型注册装饰器

在构建模型库时,常用装饰器将模型类注册到全局字典,便于通过名称动态创建。

MODEL_REGISTRY = {}defregister_model(name):defdecorator(cls): MODEL_REGISTRY[name] = clsreturn clsreturn decorator@register_model("resnet50")classResNet50:pass@register_model("vit_base")classViTBase:passdefcreate_model(name, **kwargs):return MODEL_REGISTRY[name](**kwargs)

6.8 梯度裁剪装饰器

在训练循环中,对梯度进行裁剪以防止梯度爆炸。

defclip_grad_norm(max_norm):defdecorator(train_step_func): @functools.wraps(train_step_func)defwrapper(model, *args, **kwargs): loss = train_step_func(model, *args, **kwargs) torch.nn.utils.clip_grad_norm_(model.parameters(), max_norm)return lossreturn wrapperreturn decorator@clip_grad_norm(1.0)deftrain_step(model, x, y, optimizer): optimizer.zero_grad() loss = nn.functional.mse_loss(model(x), y) loss.backward() optimizer.step()return loss

6.9 训练/评估模式切换

自动将模型切换到 train() 或 eval() 模式,并在函数执行后恢复。

defset_mode(mode='train'):defdecorator(func): @functools.wraps(func)defwrapper(model, *args, **kwargs): previous_mode = model.trainingif mode == 'train': model.train()else: model.eval()try: result = func(model, *args, **kwargs)finally:if previous_mode: model.train()else: model.eval()return resultreturn wrapperreturn decorator@set_mode('eval')defevaluate(model, dataloader):# 此时模型处于 eval 模式pass

6.10 异常重试装饰器

在数据加载或网络请求失败时自动重试。

import timedefretry(max_attempts=3, delay=1):defdecorator(func): @functools.wraps(func)defwrapper(*args, **kwargs):for attempt in range(max_attempts):try:return func(*args, **kwargs)except Exception as e: print(f"Attempt {attempt+1} failed: {e}") time.sleep(delay)raise RuntimeError(f"Failed after {max_attempts} attempts")return wrapperreturn decorator@retry(max_attempts=3)defdownload_data(url):# 可能失败的下载操作pass

7. Python 装饰器体系

7.1 内置装饰器

@staticmethod:定义静态方法,不接收隐式 self 或 cls@classmethod:定义类方法,接收类作为第一个参数

@functools.wraps:保留被装饰函数的元信息(__name__、__doc__)@functools.lru_cache:LRU 缓存函数结果,减少重复计算@functools.cached_property:属性值缓存,仅计算一次@functools.singledispatch:单分派泛型函数,根据第一个参数类型执行不同实现@functools.cache:无大小限制的简单缓存(Python 3.9+)

@contextlib.contextmanager:将生成器函数转换为上下文管理器

@dataclasses.dataclass:自动生成 __init__、__repr__ 等方法

@types.coroutine:将生成器标记为协程(旧式协程)

7.2 深度学习装饰器(常见于 PyTorch)

@torch.no_grad():禁用梯度计算,用于推理或评估阶段@torch.enable_grad():强制启用梯度,覆盖上级 no_grad 上下文@torch.inference_mode():纯推理优化模式(PyTorch ≥1.9),比 no_grad 更高效

- 异常重试装饰器:函数执行失败时自动重试(可设置次数与延迟)

- 缓存装饰器:对预处理等函数结果进行缓存(常基于

lru_cache) - 参数验证装饰器:检查输入张量的形状、类型、设备是否符合要求

- 自动设备放置:将输入张量和模型自动移动到指定设备(CPU/GPU)

- 梯度裁剪装饰器:自动对模型梯度进行裁剪,防止梯度爆炸

- 训练/评估模式切换:自动切换

model.train() 或 model.eval(),并在执行后恢复原状态 - 混合精度装饰器:自动应用自动混合精度(AMP)训练

- 模型注册装饰器:将模型类注册到全局字典,便于通过名称动态创建实例

- 钩子装饰器:为模型层注册前向或反向钩子,用于特征提取或调试

总结

Python装饰器是一种元编程工具,通过简洁的语法实现了横切关注点的分离,让代码更加模块化和可复用。本文从基础概念出发,介绍了函数装饰器、带参数装饰器、多个装饰器叠加、类装饰器,以及Python内置的常用装饰器。在深度学习领域,装饰器被广泛应用于梯度控制、性能分析、日志记录、缓存、参数验证、模型注册等场景,极大提升了开发效率和代码可读性。