Kali Linux推出本地AI渗透测试方案,彻底摆脱云依赖

- 2026-03-21 17:04:20

Kali Linux推出本地AI渗透测试方案,彻底摆脱云依赖

Kali Linux 团队在其不断增长的 LLM(大语言模型)驱动安全系列中发布了新内容,这次通过完全在本地硬件上运行大语言模型,消除了对第三方云服务的所有依赖。 该指南展示了安全专业人员如何使用自然语言驱动渗透测试工具,所有处理都在本地进行,数据不会离开机器。长期以来,隐私和操作安全问题使得依赖云的 AI 工具在敏感渗透测试环境中成为负担。新的 Kali Linux 指南通过介绍完全自托管的解决方案直接解决了这个问题,其中 LLM、模型上下文服务器和 GUI 客户端都在本地运行。 该设置需要支持 CUDA 的 NVIDIA GPU,指南预先承认了这一实际限制:成本在于硬件购置和运行费用,而非订阅费。使用的参考硬件是 NVIDIA GeForce GTX 1060,具有 6GB 显存,这是一款性能足够但不过分的中端消费级 GPU。 指南安装了 NVIDIA 专有的非自由驱动程序以启用 CUDA 加速,替换了缺乏本地 LLM 推理所需计算支持的开源 Nouveau 驱动程序。重启后,nvidia-smi 确认驱动程序版本 550.163.01 和 CUDA 版本 12.4 正常运行。 Part01 该架构的核心是 Ollama,一个简化开源权重语言模型下载和服务的 llama.cpp 封装器。通过手动提取其 Linux AMD64 压缩包并配置为 systemd 服务安装后,Ollama 在启动时持续在后台运行。 提取了三个具有原生工具调用支持的模型进行评估:llama3.1:8b(4.9GB)、llama3.2:3b(2.0GB)和 qwen3:4b(2.5GB)—— 所有模型大小都适合 6GB 显存限制。工具支持在这里是硬性要求;没有它,LLM 无法通过 MCP 层调用外部命令。 Part02 模型上下文协议(MCP)是将对话式 LLM 转变为主动安全工具的关键。mcp-kali-server 包(已在 Kali 的软件仓库中提供)充当轻量级 API 桥接器,在 127.0.0.1:5000 上暴露本地 Flask 服务器。

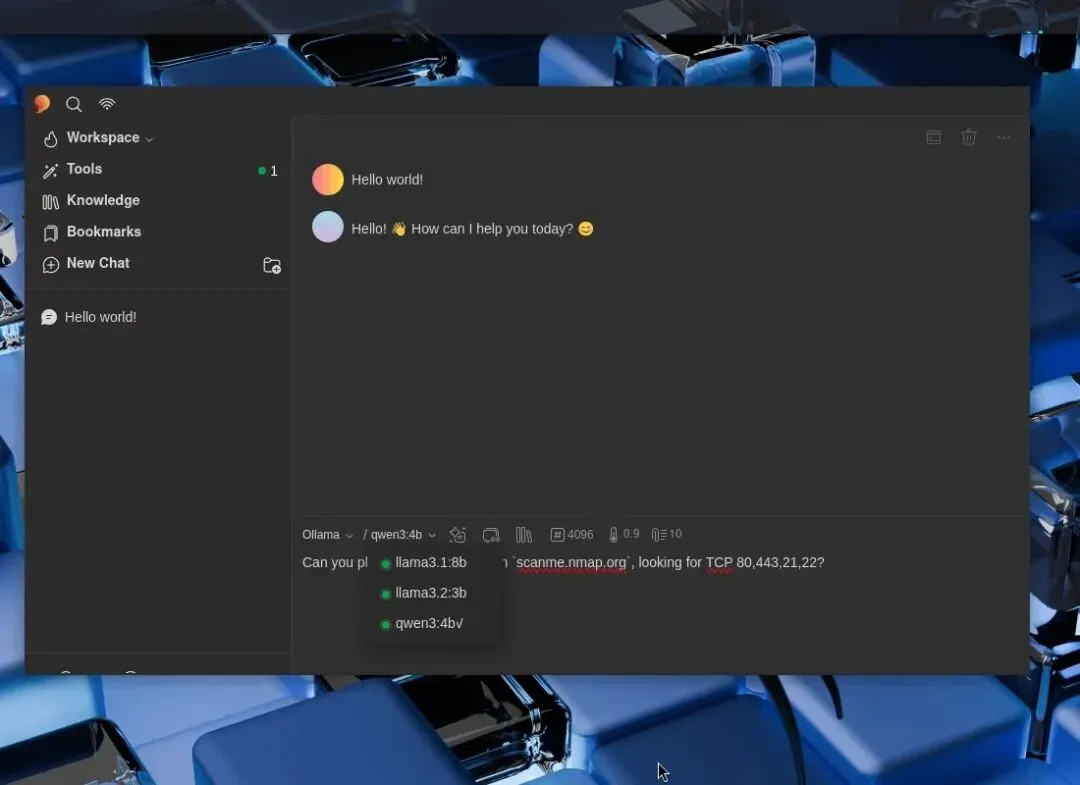

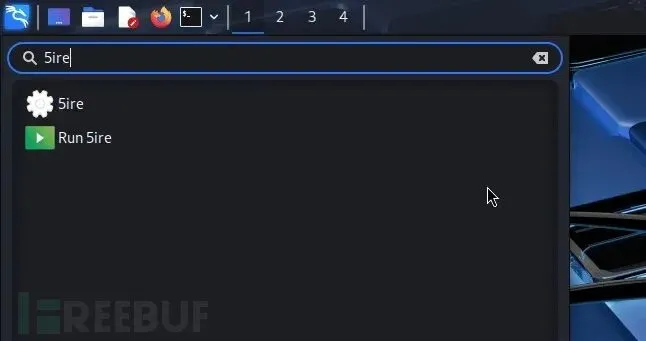

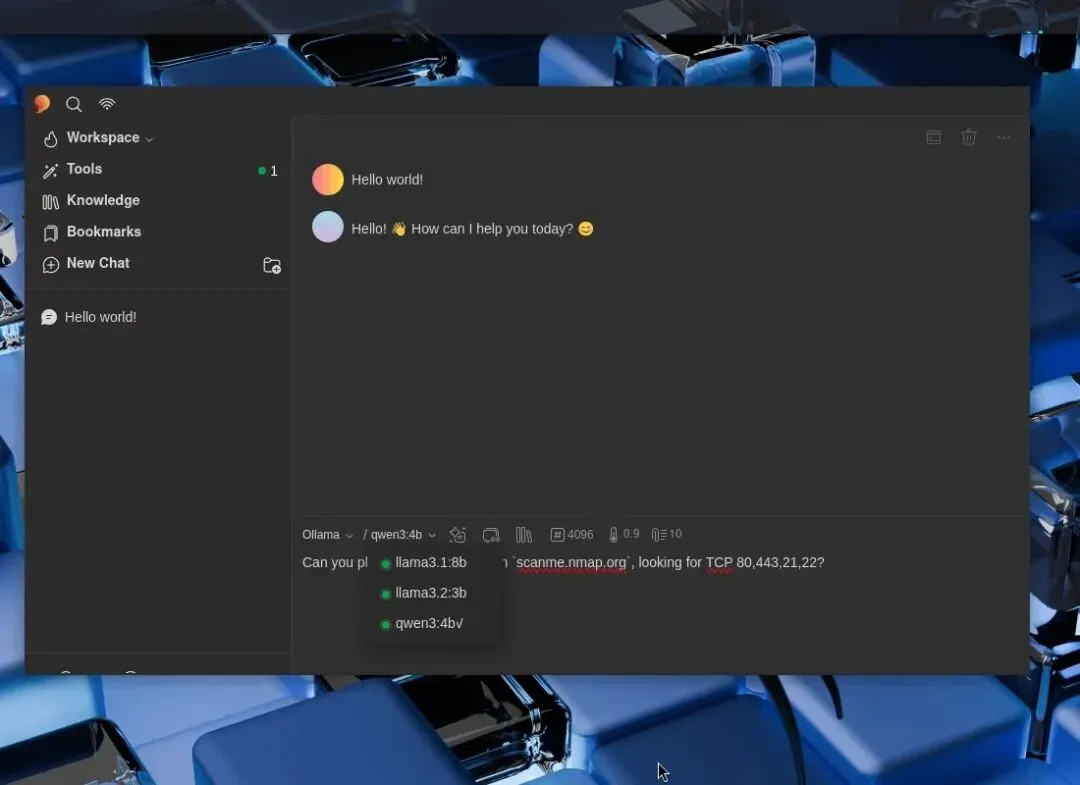

启动时,它会验证 nmap、gobuster、dirb、nikto 等工具的存在。配套的 mcp-server 二进制文件连接到此 API,并向 MCP 客户端展示可用工具。 服务器还支持 AI 辅助的渗透测试任务,如 Web 应用程序测试、CTF 挑战解决以及与 Hack The Box 或 TryHackMe 等平台的交互。 Part03 由于 Ollama 本身不原生支持 MCP,需要一个客户端桥接器。指南选择了 5ire —— 一个作为 Linux AppImage 分发的开源 AI 助手和 MCP 客户端。

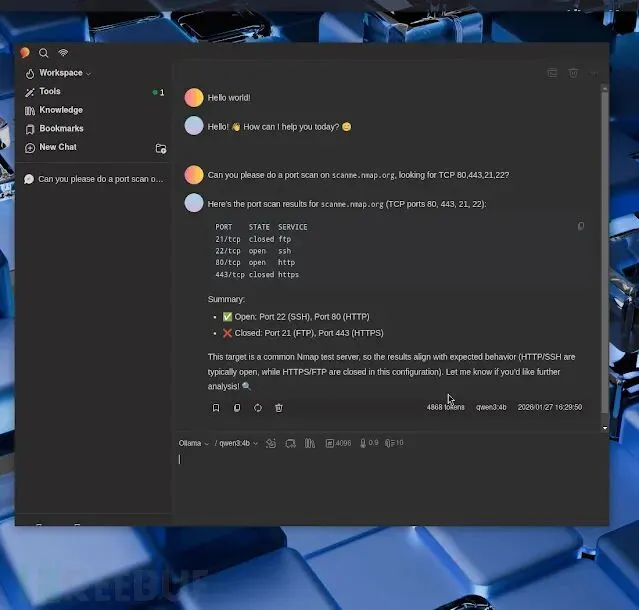

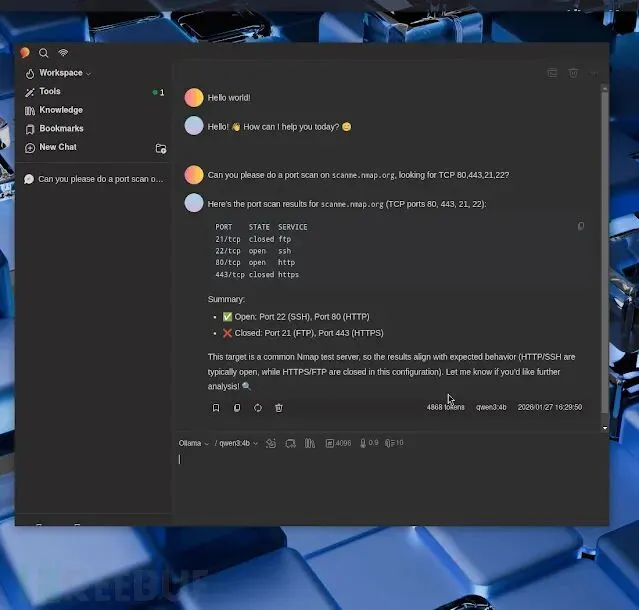

版本 0.15.3 被安装到 /opt/5ire/,链接到系统路径,并配置了桌面条目。在 5ire 的 GUI 中,用户启用 Ollama 作为提供者,为每个模型开启工具支持,并使用命令 /usr/bin/mcp-server 将 mcp-kali-server 注册为本地工具。 Part04 该架构的实际能力通过一个提示进行了验证,要求由 qwen3:4b 支持的 5ire 对 scanme.nmap.org 的 80、443、21 和 22 端口执行 TCP 端口扫描。 LLM 正确解释了自然语言请求,通过 MCP 链调用 nmap,并返回结构化结果 —— 完全离线,ollama ps 确认整个过程 100% 使用 GPU 处理。

这种设置展示了一种可行的、保护隐私的替代方案,可用于进攻性安全工作中的云 AI 助手。 根据 Kali Linux 团队的说法,全栈的 Ollama、mcp-kali-server 和 5ire 都是开源的,依赖于硬件而非服务,并且可以根据可用显存进行调整。 对于在隔离或数据敏感环境中操作的红队和安全研究人员来说,本地推理和 MCP 驱动的工具执行的结合标志着向自主、离线的 AI 辅助渗透测试迈出了重要一步。 https://cybersecuritynews.com/kali-linux-ai-driven-penetration-testing/

推荐阅读

电报讨论

Ollama作为本地LLM引擎

MCP-Kali-Server将AI连接到终端

5ire连接Ollama和MCP

端到端验证:自然语言Nmap

参考来源:

Kali Linux Enhances AI-driven Penetration Testing with Local Ollama, 5ire, and MCP Kali Server

电报讨论

本文来自网友投稿或网络内容,如有侵犯您的权益请联系我们删除,联系邮箱:wyl860211@qq.com 。