如何在Linux中部署DeepSeek

- 2026-04-16 03:38:28

一、写在前面

DeepSeek是一款领先的自然语言处理模型,其系列模型已经从最初的基础模型进化成多个不同版本,满足不同计算需求与应用场景。DeepSeek-r1是其中一款新推出的高效本地部署版本,专为提升用户在本地环境下使用DeepSeek的性能与灵活性而设计。相信大家经常遇到D老师服务器繁忙的状态,而本地部署版则可以解决这一困扰。

1、DeepSeek-r1与DeepSeek网页版模型的比较

DeepSeek的网页版模型(通常托管在云端服务器上)提供了强大的计算资源和实时更新的能力,用户可以通过互联网轻松访问。这种方式适合需要快速部署并且不担心计算资源限制的用户。然而,依赖网络连接和云服务可能存在延迟和隐私泄露的风险,尤其是在涉及敏感数据处理时。

DeepSeek-r1则是面向本地部署的优化版本,允许用户将模型直接部署在自己的服务器上进行高效计算。这种部署方式不受网络波动影响,能更好地保护数据隐私,并且在性能上也能够根据硬件资源进行优化。此外,本地部署还允许更多的定制化配置,使其能够更好地适应特定业务需求。

2、DeepSeek-r1与其他DeepSeek模型的比较

与DeepSeek的其他版本(例如DeepSeek基础版或其他大规模版本)相比,DeepSeek-r1在模型架构上进行了优化,旨在为本地部署提供更高的计算效率和资源利用率。DeepSeek-r1在内存和计算需求上做了进一步的精简,并且增加了对多个硬件架构的支持,使得不同配置的电脑/服务器都可以轻松运行。此外,DeepSeek-r1提供了不同规模的模型版本,用户可以根据自己的硬件条件和应用需求进行选择。

二、Linux系统部署DeepSeek

首先,你需要准备一个具有GPU的服务器:RTX5090、4080S、5070显卡上机

访问链接:https://biomamba.xiyoucloud.net/

更多内容可咨询客服微信[Biomamba_zhushou]

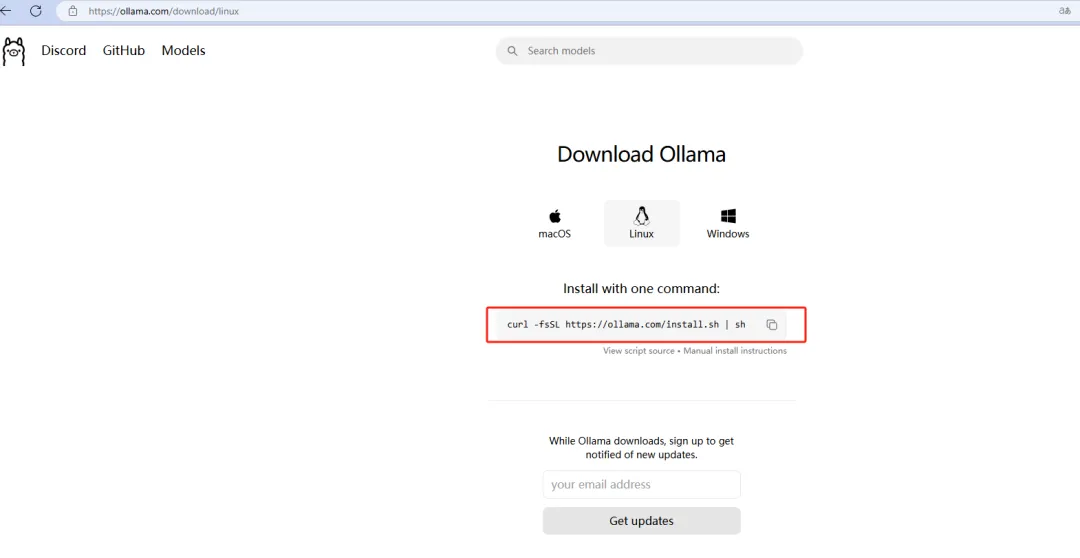

1、下载并安装ollama

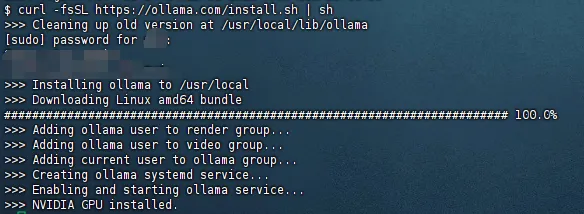

在Linux系统中我们部署DeepSeeK-r1时,第一步同样需要先安装ollama。

linux安装ollama的过程中同样可能会受到网络的影响。如果出现了下载失败的情况,可以多尝试几次。

curl -fsSL https://ollama.com/install.sh | sh

2、安装DeepSeek-r1

(1) 启动ollama

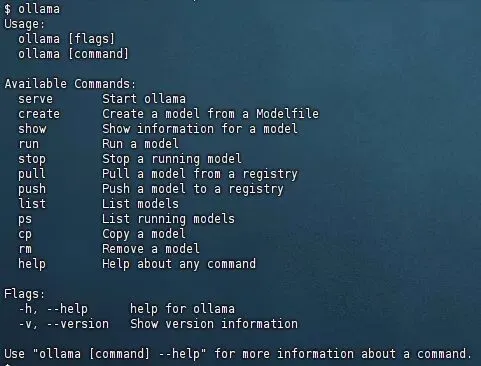

第一步我们同样先检查一下ollama是否能够正常运行。如果执行ollama命令能显示出ollama参数信息,则说明ollama可以在linux中正常运行了。

ollama

(2)安装DeepSeek-r1

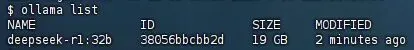

DeepSeek-r1不同版本的模型对应的大小不太相同。模型越大,则对应需要的储存空间越大,下载所需要的时间也会越长。其中32b版本的大小约19G,所以这一步骤的下载过程会消耗一些时间。

ollama run deepseek-r1:32b

(3)检查模型下载版本

ollama list

(4)开始对话

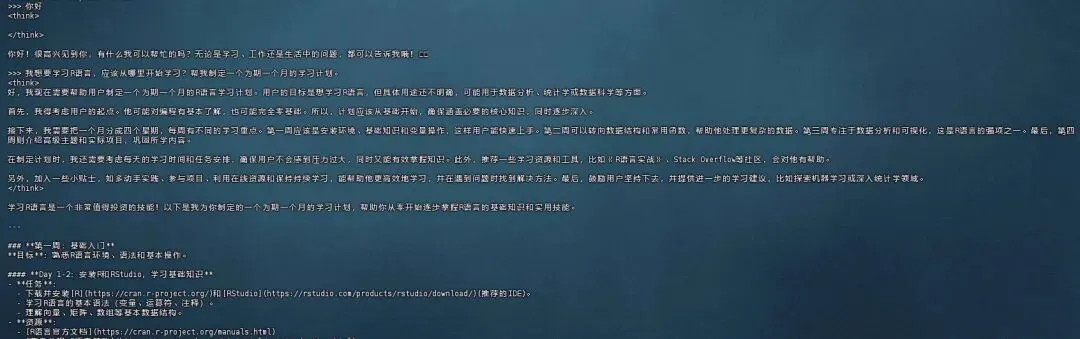

现在我们可以在Linux系统里面和DeepSeek开始聊天啦~~ 执行下面的命令,启动对话。

ollama run deepseek-r1:32b

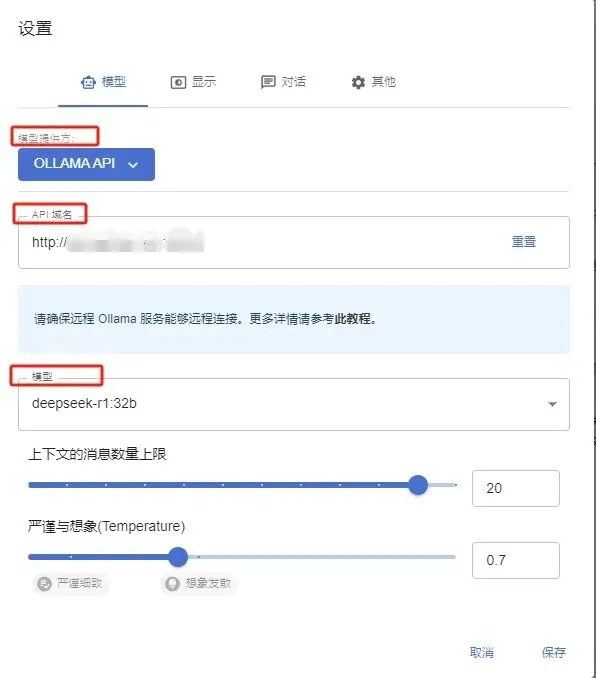

3、设置chatBox

chatBox访问端口

# 修改配置文件sudo vi /etc/systemd/system/ollama.service# 配置文件里面添加上下面这两行代码[Service]Environment="OLLAMA_HOST=目标ip:目标端口"Environment="OLLAMA_ORIGINS=*"#重新加载ollama服务sudo systemctl daemon-reloadsudo systemctl restart ollama接下来打开chatBox进入设置页面,填入自己的API域名和端口,同时模型选择自己对应下载好的模型

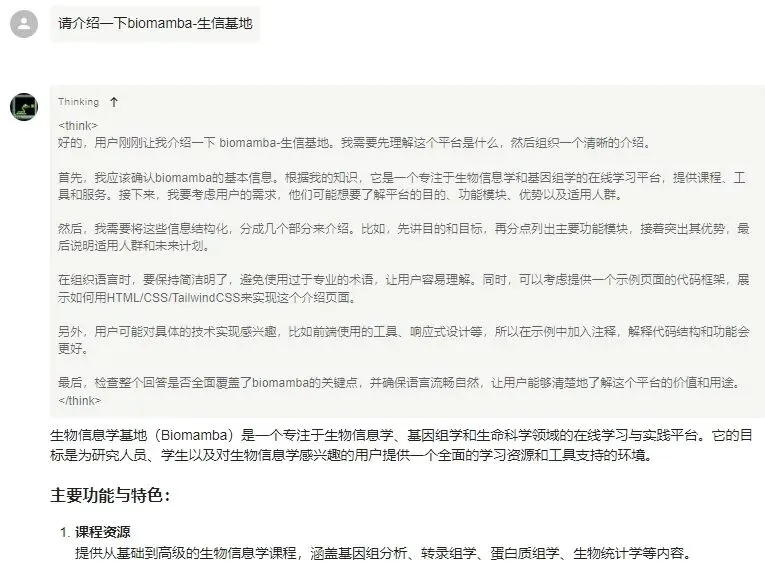

设置完成之后,点击保存,这时候再在聊天框输入我们的问题,就可以在chatbox实现对话啦~~

三、安全问题

注意,实测ollama会留后门,给服务器安全造成隐患,使用时可以把本地服务器断网处理。若是云端服务器,记得定期修改密码并且监控资源使用情况。也可以参考以下教程定期查杀病毒:

如何联系我们

已有生信基地联系方式的同学无需重复添加