跟 AI 学 Linux:SO_REUSEADDR 和 SO_REUSEPORT 对 Linux TCP bind 的影响

- 2026-03-01 00:16:28

1. 议题

从前文了解到,有两个配置项会影响 bind 系统调用的行为,而这两个配置项又有很多相似点,如何准确理解 SO_REUSEADDR 和 SO_REUSEPORT 的异同点呢?

让我们继续请 AI 老师来为我们解惑。

2. 对话

2.1 问

对于 linux 的 bind 系统调用,有两个配置会影响其行为:SO_REUSEADDR 和 SO_REUSEPORT。我不理解两者的差异,请为我详细解释两者的异同。

2.2 答

SO_REUSEADDR 的语义

对 AF_INET/AF_INET6 来说,SO_REUSEADDR 改变的是 bind() 的地址冲突验证规则:主要目的是允许在以下情形下 bind 成功 —— 比如上一个连接的端点处于 TIME_WAIT,服务器快速重启希望立即重新绑定相同端口。但并非"任意时候都能让两个监听 socket 共享同一端口"。例如:如果已有一个监听 socket 绑定在 INADDR_ANY:port,那么即使对另一个 socket 打开 SO_REUSEADDR,也通常不能再绑定同一端口到某个具体地址上(因为 INADDR_ANY 覆盖了所有地址)。这点在手册里有明确说明。

SO_REUSEPORT 的语义

SO_REUSEPORT 的设计目的就是允许多个进程/线程各自创建自己的 socket(每个都 setsockopt(..., SO_REUSEPORT, 1)),并绑定到完全相同的 address:port。内核会维护这些 socket 的组,并在接收连接时把负载分发到组内的某个 socket,从而提升并发吞吐并减少唤醒风暴。要点:必须在每个要绑定的 socket 上都先设置该选项(在调用 bind() 之前)。为了防止“端口劫持”,Linux 要求对绑定到同一个 address:port 的所有进程具有相同的有效 UID(或满足相应权限规则)。

常见误解与陷阱

1. “把 SO_REUSEADDR 打开,就能让 N 个进程同时 bind 同一端口” —— 不对。那是 SO_REUSEPORT才是为此目的设计的;SO_REUSEADDR主要是为了处理 TIME_WAIT / wildcard 地址冲突等情况。2. 设置时机:必须在 bind()之前调用setsockopt()。否则bind()已失败或已建立绑定,setsockopt()再设置也无效(取决于具体选项,但这条是通用好习惯)。3. 安全/权限:为防止“端口劫持”,Linux 要求使用 SO_REUSEPORT的进程通常拥有相同的有效 UID(手册有说明)。4. 跨平台差异:Windows/BSD 对这些选项的语义可能与 Linux 不完全一致(例如 Windows 的 SO_REUSEADDR行为更接近 BSD 的SO_REUSEPORT某些用法),所以可移植代码要小心。

2.3 思考

我理解了,SO_REUSEADDR 是为了解决特殊的地址冲突场景;SO_REUSEPORT 是为了解决高并发的瓶颈。

但是有两个地方还是很模糊:

1. SO_REUSEADDR 处理的 wildcard 地址冲突具体是什么场景? 2. SO_REUSEPORT 维护的 socket 组的分发策略是什么?以及如何减少唤醒风暴?

这两个问题再追问一下 AI 老师。

2.4 问

关于 SO_REUSEADDR 处理 wildcard 地址冲突的情况,请再为我详细解释一下。

2.5 答

下面我们只讨论 TCP,专门讲清楚:当存在 wildcard 地址(INADDR_ANY / 0.0.0.0)时,SO_REUSEADDR 如何影响 bind() 的冲突判定?

这是很多人最容易误解的地方。

先理解一个核心规则

在 Linux TCP 中,一个监听 socket 由四元组中的“本地部分”唯一标识:

(local_ip, local_port)对于监听 socket 来说:

• 0.0.0.0:8080表示监听所有本地 IP 的 8080 端口• 192.168.1.10:8080表示只监听这个特定 IP

关键点:

• 0.0.0.0是“覆盖所有地址”的 wildcard• 它和任何具体 IP 在冲突判断上是“重叠”的

SO_REUSEADDR 改变了什么?

SO_REUSEADDR 改变的是:当地址“部分重叠”时,是否允许多个 bind 共存。

但注意:它不会允许两个“活跃监听 socket”同时真正共享同一个 TCP 端口

它改变的是“冲突检查规则”,不是“允许多监听”。

TIME_WAIT + wildcard 场景

这是最重要的使用场景。

假设服务器:

bind(0.0.0.0:8080)listen()客户端连过来,连接关闭后:

(local_ip=192.168.1.10, port=8080) 进入 TIME_WAIT现在你重启服务器:

bind(0.0.0.0:8080)如果设置了 SO_REUSEADDR:

允许重新 bind因为:

• TIME_WAIT 连接是“已关闭的旧连接” • 内核允许新监听 socket 重用

最容易误解的一点

很多人认为: “SO_REUSEADDR 可以让 wildcard 和具体地址共存”

这是错误的(对 Linux TCP 而言)。

即使两个 socket 都设置了 SO_REUSEADDR:

A: bind(0.0.0.0:8080)B: bind(192.168.1.10:8080)仍然:EADDRINUSE

2.6 思考

这与我之前的认知有点儿区别。我隐约记得是可以同时 bind wildcard 和具体地址。

再继续追问无意思,我们放到实验中验证。

2.7 问

SO_REUSEPORT 维护的 socket 组的分发策略是什么?以及如何减少唤醒风暴?

2.8 答

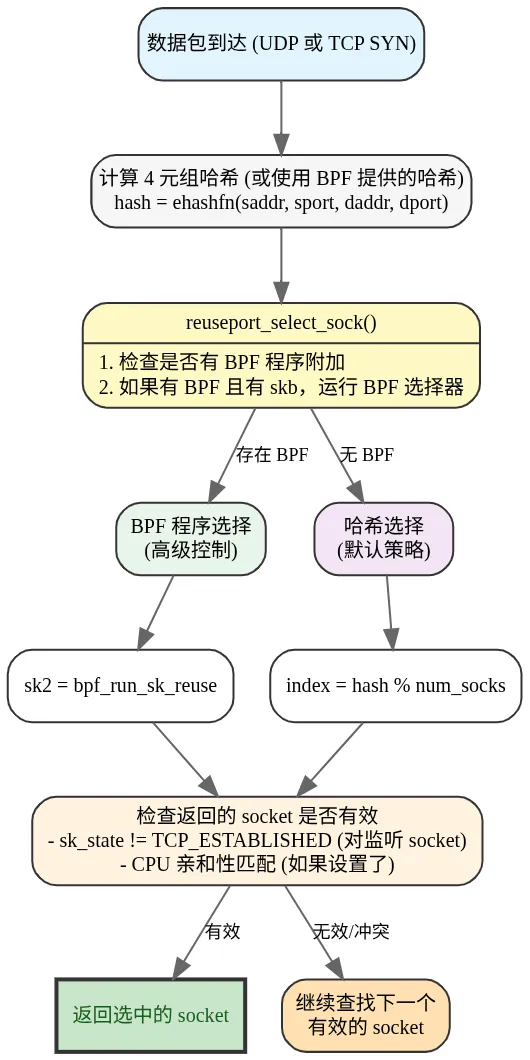

预设的选择/分发算法(内核默认)

哈希键(flow affinity):对于 TCP(和 UDP)多数实现,内核把“四元组”(peer IP/port + local IP/port)作为流的标识去做 hash,然后用这个 hash 去选择 reuseport 组中的一个 socket。这样同一流会稳定映射到同一监听 socket(便于 stateful 会话)。映射到索引的方式:内核会把 hash 值缩放到 0..N-1 的索引(实现上用类似 reciprocal_scale(phash, num_socks) 的方式),因此即使 hash 值很大,也能公平地分布到 N 个槽上(但小 N 或极端客户端分布仍会出现不均衡)。选择时机:对 TCP 来说,选择通常发生在处理到来的 SYN(或三次握手完成时创建 child socket)的时候;对 UDP 是在数据报到来时选择目标 socket。选中后,内核把连接/数据直接交给该 socket 的接收队列。

为什么能减少“惊群”?

只唤醒被选中的那个 socket(wait queue):传统单 socket + 多进程/多线程 accept 模式下,内核往往会唤醒所有在同一监听 socket 上阻塞的 accept() 线程,只有第一个 accept 成功,其他被唤醒者再次阻塞或返回 EAGAIN,造成大量无用唤醒与上下文切换(惊群)。SO_REUSEPORT 把每个进程/线程的监听放到不同的 socket 实例上,内核在收到新连接时直接选择一个 socket 并仅唤醒那一个的等待者,因此大幅降低不必要的唤醒和上下文切换。每个 socket 有自己的 accept/recv 队列:由于每个进程有独立队列,互相之间不再竞争同一队列的锁,这提高了并发性能并降低锁争用(特别在多核上效果明显)。

eBPF / 用户定义选择器(可插拔的分发)

内核可以让用户通过 BPF 自定义选择逻辑:Linux 支持 SO_ATTACH_REUSEPORT_CBPF / SO_ATTACH_REUSEPORT_EBPF,可以把一个(e)BPF 程序附到 reuseport 组上,让程序自己返回 socket 索引,进而实现更复杂/精细的调度(例如基于 CPU/receive-queue、连接计数、应用层元数据等)。若 BPF 返回非法值,会回退到默认哈希选择。为什么有用:可以把 socket 分配与 NIC 的 RSS/queue 绑定,或者实现基于活跃连接数的动态调度,解决默认 Hash 在极端分布下的偏斜问题。许多高性能部署会用 eBPF 把 socket 映射到处理该 NIC 收包队列的线程/核上,从而最小化跨 CPU 传输与缓存失效。

给开发者/运维的实战建议(Checklist)

1. 如果你只是想避免惊群并提高多核并发,优先使用 SO_REUSEPORT(所有监听进程都必须在 bind 前设置)。 2. 若需保证会话粘性且要避免索引变动问题,考虑用 eBPF 的 reuseport map(BPF_MAP_TYPE_REUSEPORT_SOCKARRAY/SOCKHASH)来稳定分配。 3. 在流量很不均匀或客户端稀少时,监控每个 worker 的 accept/conn/byte 负载,必要时用 eBPF 或用户层再平衡(基于连接数)。 4. 把 SO_REUSEPORT 与 NIC RSS / CPU-affinity / RPS 配合使用,把处理线程和接收队列尽量对齐,减少跨核数据搬运。 5. 注意内核版本与权限:确认系统内核对 reuseport 的支持(Linux 3.9+ 引入,后续内核加入 eBPF 支持与改进),并且进程 UID 等可能影响绑定行为。

3. 实验

完整代码位于我的 gitee 仓库[1]。

3.1 SO_REUSEADDR 通配符绑定

========================================场景1: bind → listen → bind → listen========================================步骤1: 绑定并监听 127.0.0.1:18888 (具体地址)[Socket-Specific] 已设置 SO_REUSEADDR[Socket-Specific] bind(127.0.0.1:18888) 成功![Socket-Specific] listen 成功,socket fd = 3步骤2: 绑定并监听 0.0.0.0:18888 (通配符地址)[Socket-Wildcard] 已设置 SO_REUSEADDR[Socket-Wildcard] bind(0.0.0.0:18888) 失败: Address already in use[Socket-Wildcard] 跳过 listen (socket 未创建)--- 场景1 结果 ---Bind 结果: Socket-Specific ✓ 成功, Socket-Wildcard ✗ 失败Listen 结果: Socket-Specific ✓ 成功, Socket-Wildcard ✗ 失败========================================场景2: bind → bind → listen → listen========================================步骤1: 先绑定 127.0.0.1:18888 (具体地址)[Socket-Specific] 已设置 SO_REUSEADDR[Socket-Specific] bind(127.0.0.1:18888) 成功!步骤2: 再绑定 0.0.0.0:18888 (通配符地址)[Socket-Wildcard] 已设置 SO_REUSEADDR[Socket-Wildcard] bind(0.0.0.0:18888) 成功!步骤3: 对 Socket-Specific 执行 listen[Socket-Specific] listen 成功,socket fd = 3步骤4: 对 Socket-Wildcard 执行 listen[Socket-Wildcard] listen 失败: Address already in use--- 场景2 结果 ---Bind 结果: Socket-Specific ✓ 成功, Socket-Wildcard ✓ 成功Listen 结果: Socket-Specific ✓ 成功, Socket-Wildcard ✗ 失败========================================场景3: 反向 - 先通配符,后具体========================================步骤1: 先绑定 0.0.0.0:18888 (通配符地址)[Socket-Wildcard] 已设置 SO_REUSEADDR[Socket-Wildcard] bind(0.0.0.0:18888) 成功!步骤2: 再绑定 127.0.0.1:18888 (具体地址)[Socket-Specific] 已设置 SO_REUSEADDR[Socket-Specific] bind(127.0.0.1:18888) 成功!步骤3: 对两个 socket 执行 listen[Socket-Wildcard] listen 成功,socket fd = 3[Socket-Specific] listen 失败: Address already in use--- 场景3 结果 ---Bind 结果: Socket-Wildcard ✓ 成功, Socket-Specific ✓ 成功Listen 结果: Socket-Wildcard ✓ 成功, Socket-Specific ✗ 失败我设计了三个场景,分别检查 bind 和 listen 两个系统调用的结果。

总的来说,ChatGPT 老师是对的:加上 SO_REUSEADDR 配置,虽然可以 bind 成功,但是无法转入 LISTEN 状态,不允许两个活跃监听 socket 同时共享同一个 TCP 端口。

3.2 SO_REUSEPORT 负载分发

=== 实验2: SO_REUSEPORT 负载分发演示 ===启动 4 个 worker 进程,共享端口 18890[主进程] 创建 listen fd=3 用于 Worker-1[主进程] 创建 listen fd=4 用于 Worker-2[主进程] 创建 listen fd=5 用于 Worker-3[主进程] 创建 listen fd=6 用于 Worker-4--- Worker 进程已就绪 ---测试方法: 在另一个终端运行以下命令之一: 1. 简单测试: nc localhost 18890 2. 循环测试: for i in {1..20}; do echo test$i | nc localhost 18890; done 3. 并发测试: for i in {1..10}; do (nc localhost 18890 &); done观察: 来自同一客户端的连接会被分发到哪个 worker提示: 内核使用四元组哈希,同一流会映射到同一 worker[主进程] Worker-1 (PID=1412467) 已启动[Worker-1] 启动,监听 fd=3[主进程] Worker-2 (PID=1412468) 已启动[主进程] Worker-3 (PID=1412469) 已启动[Worker-2] 启动,监听 fd=4[主进程] Worker-4 (PID=1412470) 已启动=== 所有 worker 已启动,等待连接... ===按 Ctrl+C 退出[Worker-3] 启动,监听 fd=5[Worker-4] 启动,监听 fd=6启动4个 Worker 监听 18890 端口,然后用 nc 命令建连接:

[Worker-4] 接受连接 #1 来自 127.0.0.1:12345 (运行时间: 105908ms)[Worker-4] 接受连接 #2 来自 127.0.0.1:12345 (运行时间: 107598ms)[Worker-4] 接受连接 #3 来自 127.0.0.1:12345 (运行时间: 109217ms)[Worker-4] 接受连接 #4 来自 127.0.0.1:12345 (运行时间: 111222ms)[Worker-4] 接受连接 #5 来自 127.0.0.1:12346 (运行时间: 115585ms)[Worker-3] 接受连接 #1 来自 127.0.0.1:12347 (运行时间: 129101ms)[Worker-3] 接受连接 #2 来自 127.0.0.1:12347 (运行时间: 138614ms)[Worker-4] 接受连接 #6 来自 127.0.0.1:12345 (运行时间: 143099ms)相同客户端端口号的连接总是被分配到同一个 Worker。

4. 内核实现

4.1 任务

请梳理 @net/ 目录下 SO_REUSEADDR 和 SO_REUSEPORT 相关的源码,生成报告。需要讲清楚:

• SO_REUSEADDR 处理 TIME_WAIT 地址冲突的逻辑 • SO_REUSEPORT 中 socket 组相关的数据结构 • SO_REUSEPORT 中 socket 的分发流程和分发策略

4.2 报告

内核版本: Linux 5.15.198相关目录: net/, include/net/

完成的报告在 04_SO_REUSEADDR_REUSEPORT_analysis.md[1],这里仅摘要关键点。

TIME_WAIT 冲突处理流程

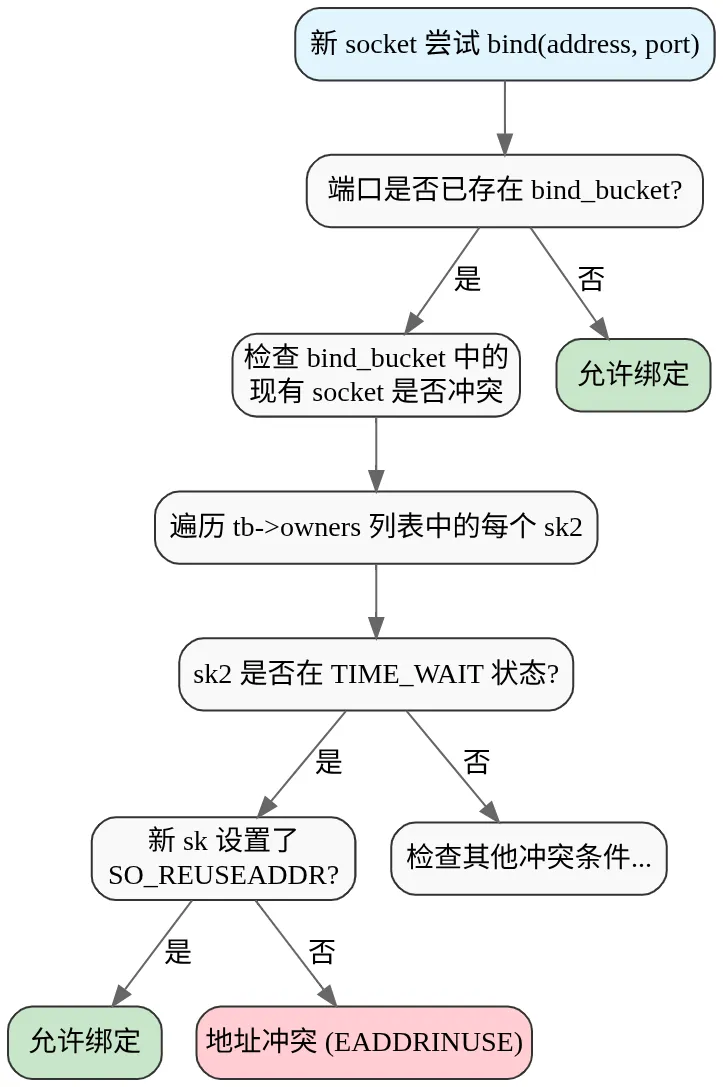

关键点总结

• TIME_WAIT 状态: 当 socket 进入 TIME_WAIT 状态时,会保留原 socket 的 sk_reuse设置• 冲突检查: inet_csk_bind_conflict()函数遍历 bind_bucket 中的所有 socket• 重用条件: 1. 新 socket 设置了 SO_REUSEADDR2. 冲突的 socket 处于 TCP_TIME_WAIT状态3. 地址和端口匹配

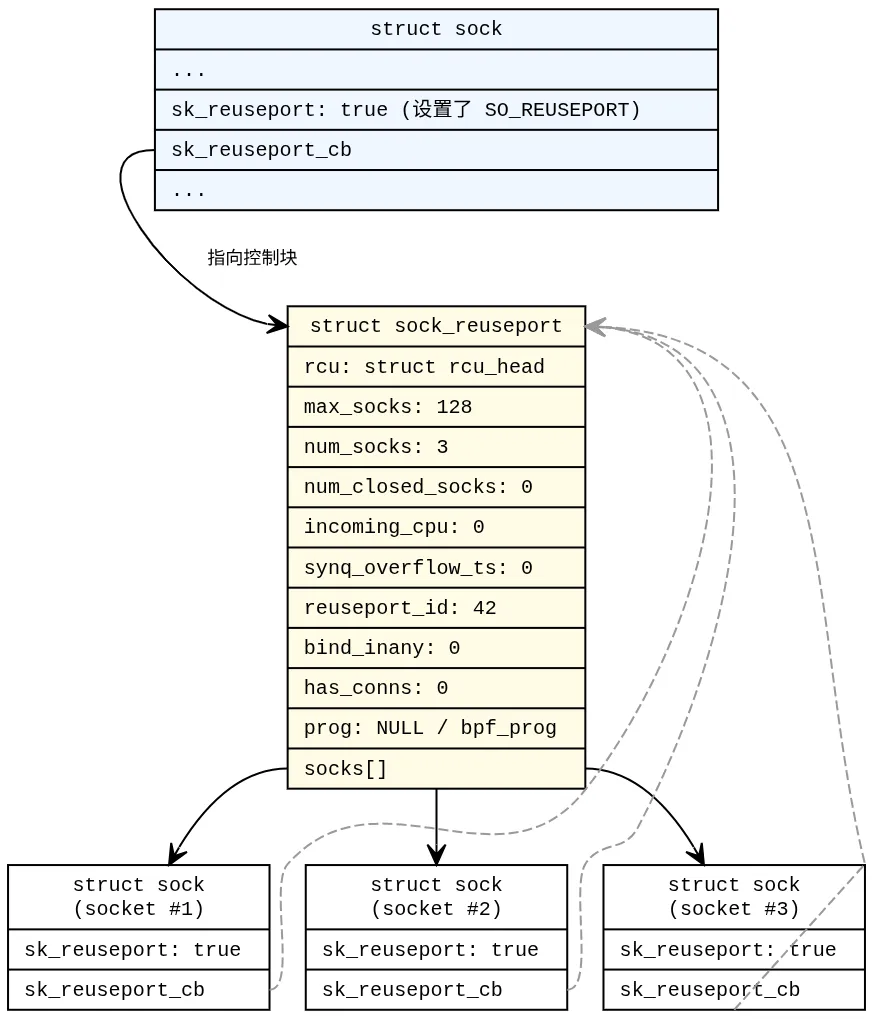

struct sock_reuseport 数据结构

定义在 include/net/sock_reuseport.h:13-30:

struct sock_reuseport {struct rcu_head rcu; u16 max_socks; /* socks 数组的长度 */ u16 num_socks; /* socks 数组中的有效元素数 */ u16 num_closed_socks; /* 已关闭的 socks 数量 */ u16 incoming_cpu; /* 该 reuse->socks[] 组的最后一次 synq 溢出时间戳 */ unsigned int synq_overflow_ts; /* 即使 socks[] 增长,ID 也保持不变 */ unsigned int reuseport_id; unsigned int bind_inany:1; unsigned int has_conns:1;struct bpf_prog __rcu *prog; /* 可选的 BPF socket 选择器 */struct sock *socks[]; /* socket 指针数组(柔性数组)*/};关系图

SO_REUSEPORT 中 socket 的分发流程和分发策略

TCP 监听 socket 查找流程

SYN 包到达 │ ▼__inet_lookup_listener() (net/ipv4/inet_hashtables.c:299) │ ▼inet_lhash2_lookup() (net/ipv4/inet_hashtables.c:248) │ ▼inet_lookup_reuseport() (net/ipv4/inet_hashtables.c:222) │ ▼reuseport_select_sock() (net/core/sock_reuseport.c:569)分发策略流程图

5. 总结

通过本文的对话、实验和源码分析,我们对 SO_REUSEADDR 和 SO_REUSEPORT 有了清晰的认识:

1. SO_REUSEADDR:主要用于解决 TIME_WAIT 状态下的地址重用问题,允许服务器快速重启并立即绑定相同的端口。但不会允许多个活跃的监听 socket 共享同一端口。 2. SO_REUSEPORT:专为多进程/多线程并发场景设计,允许多个独立的 socket 绑定到完全相同的地址:端口,内核通过哈希算法将连接分发到不同的 socket,从而有效避免"惊群效应"。

1. https://gitee.com/shichaoyuan/learn-linux-with-ai↩︎